InternLM Research Group Releases InternLM2-Math-Plus: A Series of Math-Focused LLMs

Команда исследований InternLM занимается разработкой и усовершенствованием больших языковых моделей (LLM), специально разработанных для математического рассуждения и решения проблем. Эти модели созданы для усиления возможностей искусственного интеллекта в решении сложных математических задач, включая формальные доказательства и неформальное решение проблем.

Практические решения и ценность

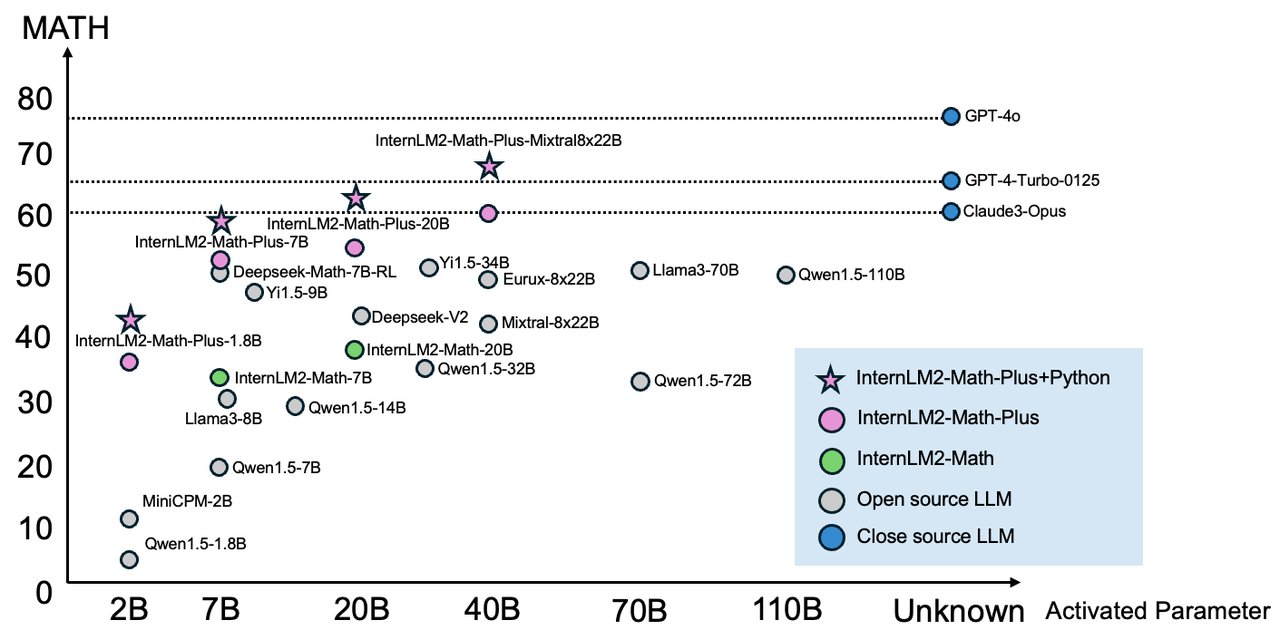

Модели InternLM2-Math-Plus включают в себя варианты с 1,8 миллиарда, 7 миллиардов, 20 миллиардов и 8×22 миллиарда параметров, нацеленные на улучшение неформального и формального математического рассуждения благодаря усовершенствованным методикам обучения и наборам данных. Эти модели стремятся сократить разрыв в производительности и эффективности при решении сложных математических задач.

Значимые результаты

Каждый вариант InternLM2-Math-Plus разработан для решения конкретных задач в математическом рассуждении. 1,8B модель обеспечивает баланс между производительностью и эффективностью, идеально подходя для приложений, требующих надежных, но компактных моделей. 7B модель предоставляет улучшенные возможности для более сложных задач по решению проблем. 20B модель дальше расширяет границы производительности, что делает ее подходящей для высокотребовательных математических вычислений. Модель Mixtral8x22B с обширными параметрами обеспечивает непревзойденную точность и точность, что делает ее предпочтительным выбором для самых сложных математических задач.

Заключение

Исследование InternLM2-Math-Plus является существенным прорывом в математических возможностях LLM. Модели эффективно решают ключевые проблемы, интегрируя сложные методики обучения и используя обширные наборы данных, улучшая производительность на различных математических показателях.