Нейронный поиск архитектуры (NAS): современное средство для автоматизации проектирования нейронных сетей

Нейронный поиск архитектуры (NAS) является мощным инструментом для автоматизации проектирования архитектур нейронных сетей, обладая явным преимуществом перед ручными методами проектирования. Он значительно сокращает время и усилия специалистов, необходимые для разработки архитектуры. Однако традиционный NAS сталкивается с серьезными проблемами из-за зависимости от обширных вычислительных ресурсов, особенно графических процессоров (GPU), для навигации по большим пространствам поиска и выявления оптимальных архитектур. Эти ресурсоемкие методы являются непрактичными для устройств с ограниченными ресурсами, что ограничивает их широкое применение.

Практические решения

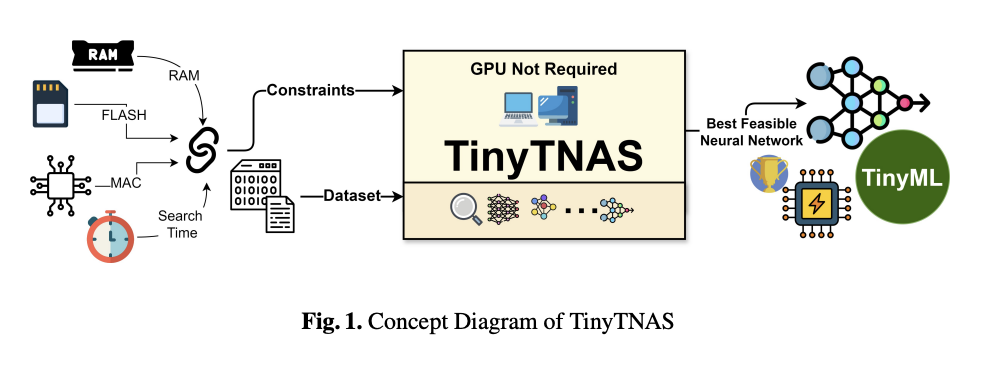

Команда исследователей из Индийского института технологий в Кхарагпуре предложила TinyTNAS — передовой инструмент для аппаратно-ориентированного многокритериального поиска архитектуры нейронных сетей, специально разработанный для классификации временных рядов в TinyML. TinyTNAS эффективно работает на процессорах, что делает его более доступным и практичным для широкого спектра приложений. Он позволяет пользователям устанавливать ограничения на оперативную память, флэш-память и операции MAC для обнаружения оптимальных архитектур нейронных сетей в этих параметрах. Уникальной особенностью TinyTNAS является его способность выполнять поиск в ограниченное время, обеспечивая нахождение наилучшей модели в заданный пользователем срок.

Результаты демонстрируют выдающуюся производительность TinyTNAS на всех пяти наборах данных. Он достигает значительного снижения использования ресурсов на наборе данных UCIHAR, включая оперативную память, операции MAC и флэш-память, при этом обеспечивает превосходную точность и сокращает задержку в 149 раз. Результаты для наборов данных PAMAP2 и WISDM показывают 6-кратное снижение использования оперативной памяти и значительное сокращение других ресурсов без потери точности. TinyTNAS гораздо более эффективен, так как завершает процесс поиска за 10 минут в среде процессора. Эти результаты подтверждают эффективность TinyTNAS в оптимизации архитектур нейронных сетей для ресурсоемких приложений TinyML.

Заключение

В данной работе исследователи представили TinyTNAS, который представляет собой значительное совершенствование в сфере поиска архитектуры нейронных сетей для классификации временных рядов на устройствах с ограниченными ресурсами. Он эффективно работает на процессорах без использования графических процессоров и позволяет пользователям устанавливать ограничения на оперативную память, флэш-память и операции MAC для нахождения оптимальных архитектур нейронных сетей. Результаты на нескольких наборах данных демонстрируют его значительные улучшения производительности по сравнению с существующими методами. Эта работа поднимает планку для оптимизации конструкций нейронных сетей для приложений искусственного интеллекта в интернете вещей (AIoT) и встраиваемых приложений искусственного интеллекта с низкой стоимостью и потреблением энергии. Это одно из первых усилий создать инструмент NAS, специально предназначенный для классификации временных рядов в TinyML.