Долгосрочные большие языковые модели (LLMs)

Долгосрочные большие языковые модели предназначены для обработки длинных последовательностей данных, что позволяет им эффективно понимать и обрабатывать большие объемы информации. С увеличением вычислительных мощностей, LLMs могут выполнять разнообразные задачи, особенно в области знаний, где важна генерация на основе извлеченной информации (RAG).

Проблемы и решения

Простое увеличение объема информации не всегда улучшает производительность. Изучения показывают, что слишком много информации может создавать шум и снижать эффективность работы моделей. Это делает масштабирование LLMs в контексте RAG сложной задачей.

Эффективные методы

Ранние исследования сосредоточены на использовании разреженных и низкоранговых ядер для снижения требований к памяти. Также предлагаются рекуррентные и пространственные модели как альтернативы трансформерам. Новые методы внимания позволяют LLMs обрабатывать последовательности из миллионов токенов.

Улучшение обучения в контексте

Обучение в контексте (ICL) помогает моделям быть более эффективными, демонстрируя им примеры задачи во время обработки. Для улучшения ICL исследователи разрабатывают методы предобучения, чтобы модели лучше понимали контекст.

Инновации в RAG

В последние годы предложены методы для обработки больших документов и увеличения хранилищ для извлеченных данных, что улучшает производительность RAG.

Новые стратегии

Группа исследователей из Google DeepMind и других университетов изучила масштабирование вычислений для RAG, сосредоточившись на обучении в контексте и итеративном запросе. Эти стратегии обеспечивают гибкость в распределении вычислительных ресурсов и улучшают способность LLMs эффективно использовать контекст.

Результаты исследований

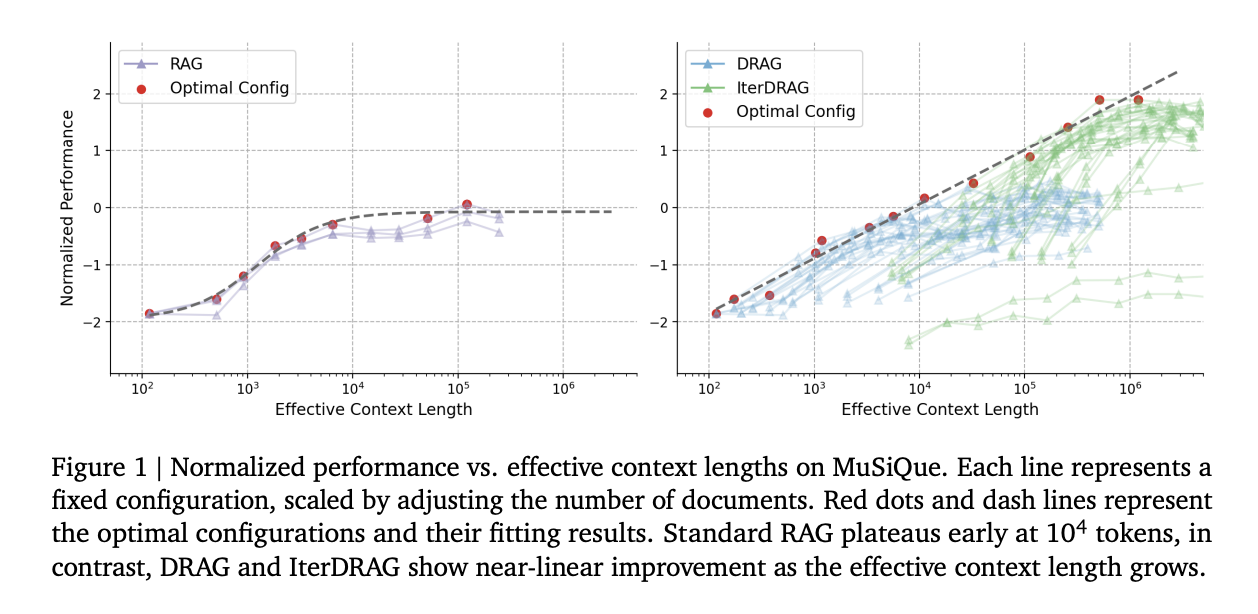

Исследования показали, что увеличение вычислений приводит к линейному росту производительности RAG при оптимальном распределении. Разработаны модели для оценки производительности RAG в различных условиях вычислений. Введены новые подходы, такие как DRAG и IterDRAG, которые помогают моделям находить и применять релевантную информацию, улучшая результаты.

Заключение

Введение стратегий DRAG и IterDRAG значительно увеличивает вычислительную эффективность RAG. Эти методы показывают лучшие результаты по сравнению с традиционными подходами, основанными на увеличении объема извлекаемых документов. Оптимальные конфигурации позволяют добиться значительных улучшений производительности, что открывает новые горизонты для исследований в области оптимизации стратегий вывода для долгосрочных RAG.

Внедрение ИИ в бизнес

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта, грамотно используйте новые технологии. Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации и какие ключевые показатели эффективности (KPI) вы хотите улучшить с помощью ИИ.

Подберите подходящее решение: начните с малого проекта, анализируйте результаты и KPI, затем расширяйте автоматизацию на основе полученного опыта.

Если вам нужны советы по внедрению ИИ, пишите нам.

Попробуйте ИИ ассистент в продажах, который помогает отвечать на вопросы клиентов и генерировать контент для отдела продаж, снижая нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от Flycode.ru.