Retrieval Augmented Generation (RAG) — новый метод улучшения возможностей больших языковых моделей (LLM)

Метод RAG улучшает возможности LLM, интегрируя систему извлечения документов. Это позволяет LLM получать актуальную информацию из внешних источников, улучшая точность и релевантность сгенерированных ответов. RAG решает ограничения традиционных LLM, такие как необходимость обширного обучения и риск предоставления устаревшей или неверной информации.

Преимущества RAG

RAG позволяет модели оперировать надежными источниками, уменьшая вероятность ошибок и обеспечивая актуальные знания без дорогостоящего постоянного обучения.

Проблема многогранных запросов

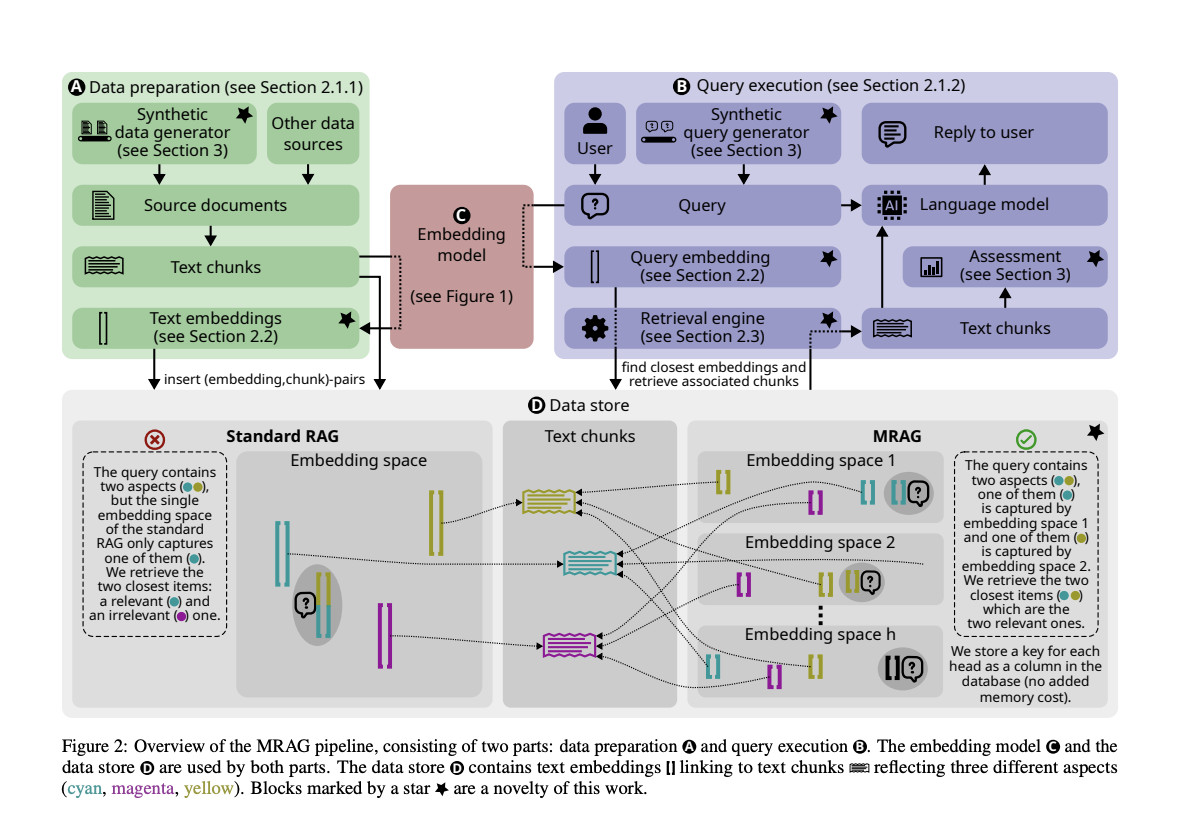

Одной из проблем RAG является обработка запросов, требующих нескольких документов с разнообразным содержанием. Такие запросы встречаются в различных отраслях, но представляют сложность из-за различных вложенных данных.

Решение — Multi-Head RAG (MRAG)

MRAG разработан для эффективного извлечения информации из различных источников, улучшая точность и релевантность при работе с многогранными запросами.

Преимущества MRAG

MRAG значительно улучшает точность извлечения, демонстрируя до 20% лучшую производительность по сравнению с базовыми версиями RAG. Кроме того, MRAG является эффективным и экономичным методом, не требующим дополнительных запросов LLM, увеличенного хранения или множественных проходов по модели вложений.

Заключение

MRAG представляет значительное развитие в области RAG, решая проблемы многогранных запросов и улучшая точность и эффективность извлечения документов. Это открывает путь для более надежных и актуальных результатов от LLM, что приносит пользу различным отраслям, требующим комплексных возможностей извлечения данных.