Инновационные решения для обработки текстов

Retrieval-augmented generation (RAG), или метод улучшенной генерации с поиском, является техникой, которая повышает эффективность больших моделей языка в обработке обширных объемов текста. Важность этой техники проявляется в естественной обработке языка, особенно в таких задачах, как вопросно-ответная система, где поддержание контекста информации имеет решающее значение для генерации точных ответов.

Проблема длинных контекстов в больших моделях языка

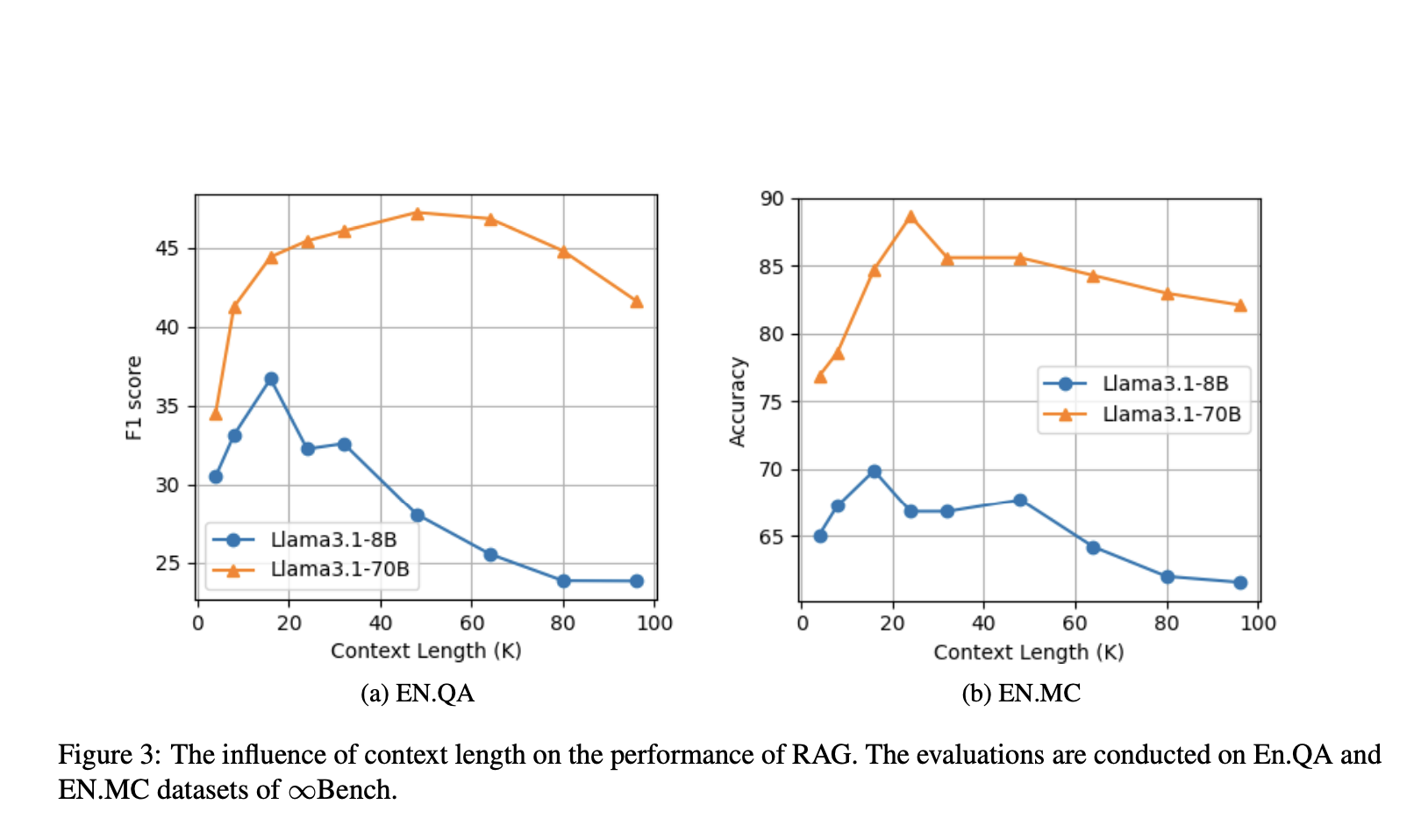

Одной из основных проблем существующих больших моделей языка (LLM) является сложность управления длинными контекстами. По мере увеличения длины контекста модели нуждаются в помощи для поддержания четкой фокусировки на актуальной информации, что может привести к существенному снижению качества их ответов.

В последние годы были предприняты усилия по расширению возможностей обработки и извлечения соответствующей информации из обширных текстовых данных.

Описание метода OP-RAG

Исследователи из NVIDIA предложили подход order-preserve retrieval-augmented generation (OP-RAG) для решения этих проблем. OP-RAG предлагает существенное улучшение по сравнению с традиционными методами RAG путем сохранения порядка извлеченных текстовых фрагментов для обработки. В отличие от существующих систем RAG, которые определяют приоритет частей на основе оценок их значимости, механизм OP-RAG сохраняет исходную последовательность текста, обеспечивая поддержание контекста и последовательности.

Этот метод предлагает инновационный механизм, который перестраивает способы обработки информации. Вместо ранжирования по значимости, OP-RAG обеспечивает сохранение порядка фрагментов для того, чтобы модель могла сконцентрироваться на извлечении наиболее контекстуально значимых данных без введения ненужных отвлекающих элементов.

Преимущества метода OP-RAG

Эксперименты показали, что данное решение значительно улучшает качество генерации ответов, особенно в случае длинных контекстов, где важна последовательность.

Сравнения также показали, что OP-RAG улучшает качество сгенерированных ответов и существенно уменьшает количество токенов, необходимых для работы модели, что делает ее более эффективной.

В заключение, OP-RAG представляет собой значительный прорыв в области улучшенной генерации с поиском, предлагая решение для ограничений длинных контекстов в LLM. Этот инновационный подход превосходит существующие методы по качеству и эффективности, что делает его многообещающим решением для будущих разработок в области естественной обработки языка.