Преимущества использования технологии Knowledge Distillation и Multi-Teacher Learning

Knowledge Distillation (передача знаний) стала популярной техникой для передачи экспертизы модели «учителя» более компактной модели «студента». Это позволяет модели «студента» превзойти производительность модели «учителя». Этот подход расширился до ансамблевой дистилляции и использования Foundation Models (FMs) таких как CLIP и DINOv2, известных своими возможностями zero-shot и сегментации объектов.

Практические решения и ценность

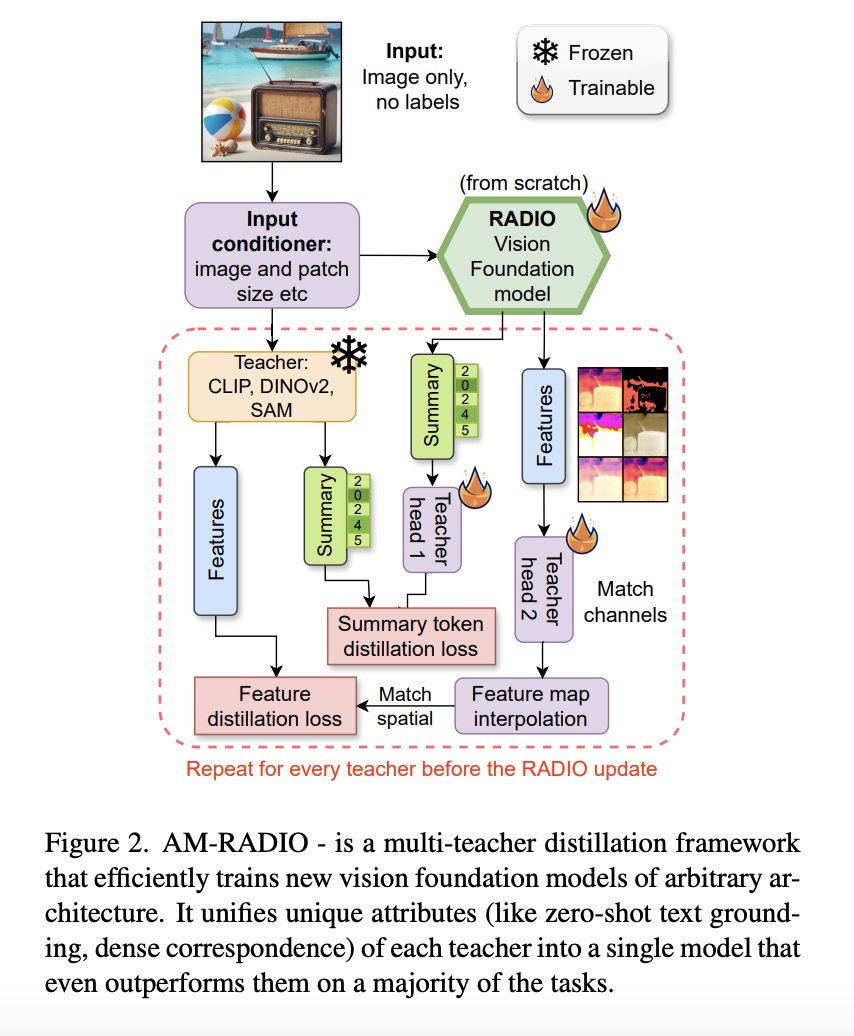

Недавно была представлена AM-RADIO, позволяющая использовать несколько основных моделей одновременно, превзойдя оригинальные модели, такие как CLIP и DINOv2. Также была разработана новая гибридная архитектура E-RADIO, преодолевающая оригинальные модели и обладающая улучшенной эффективностью.

AM-RADIO исследует возможность обучения модели «учителя» с нуля через многопреподавательскую дистилляцию, демонстрируя превосходную производительность в различных задачах, включая визуальные вопросы и сегментацию объектов.

Если вы хотите узнать больше о применении искусственного интеллекта в вашем бизнесе, свяжитесь с нами на Telegram.

Попробуйте наш ИИ ассистент в продажах, который поможет вам эффективнее взаимодействовать с клиентами и улучшить процессы продаж: ИИ ассистент в продажах.

Узнайте, как решения от Flycode.ru могут изменить ваши бизнес-процессы с помощью искусственного интеллекта.