«`html

AI Решения для Развития Вашего Бизнеса

Практические Решения и Значение MagpieLM-4B-Chat-v0.1 и MagpieLM-8B-Chat-v0.1

Университет Вашингтона и Allen Institute for AI (Ai2) недавно внесли значительный вклад в сообщество исследований по искусственному интеллекту, выпустив передовые языковые модели: MagpieLM-4B-Chat-v0.1 и MagpieLM-8B-Chat-v0.1. Эти модели, являющиеся частью более крупного проекта MagpieLM, специально разработаны для решения растущей потребности в выровненных языковых моделях, способных выполнять сложные задачи генерации текста, соблюдая человеческие ценности и ожидания. Они вызвали оживление в сообществе исследователей по искусственному интеллекту своей производительностью и прозрачностью.

Модели MagpieLM-Chat

MagpieLM-Chat модели, MagpieLM-4B-Chat-v0.1 и MagpieLM-8B-Chat-v0.1, – две новые языковые модели, оптимизированные для выравнивания. Они специально обучены таким образом, чтобы их результаты соответствовали инструкциям человека, этическим стандартам и поведенческим ожиданиям. Версия 8B относится к модели с 8 миллиардами параметров, в то время как версия 4B – это уменьшенный вариант, уменьшенный по размеру, но все еще очень эффективный.

Открытый и Прозрачный Подход

Одним из заметных аспектов проекта MagpieLM-Chat является его приверженность открытости и воспроизводимости. Команда сделала модели и все соответствующие данные, конфигурации и журналы доступными для общественности. Это включает два критически важных набора данных: набор данных для прямого тонкого настройки (SFT) и набор данных для прямой оптимизации предпочтений (DPO). Благодаря публикации этих данных наряду с моделями, исследовательская команда сделала возможным для любого желающего воспроизвести процессы обучения и выравнивания в рамках своих исследований. Это ключевой шаг к демократизации исследований в области искусственного интеллекта и гарантирует, что больше людей имеют доступ к инструментам, необходимым для построения и оценки выровненных языковых моделей.

Конкурентоспособная Производительность и Оценка

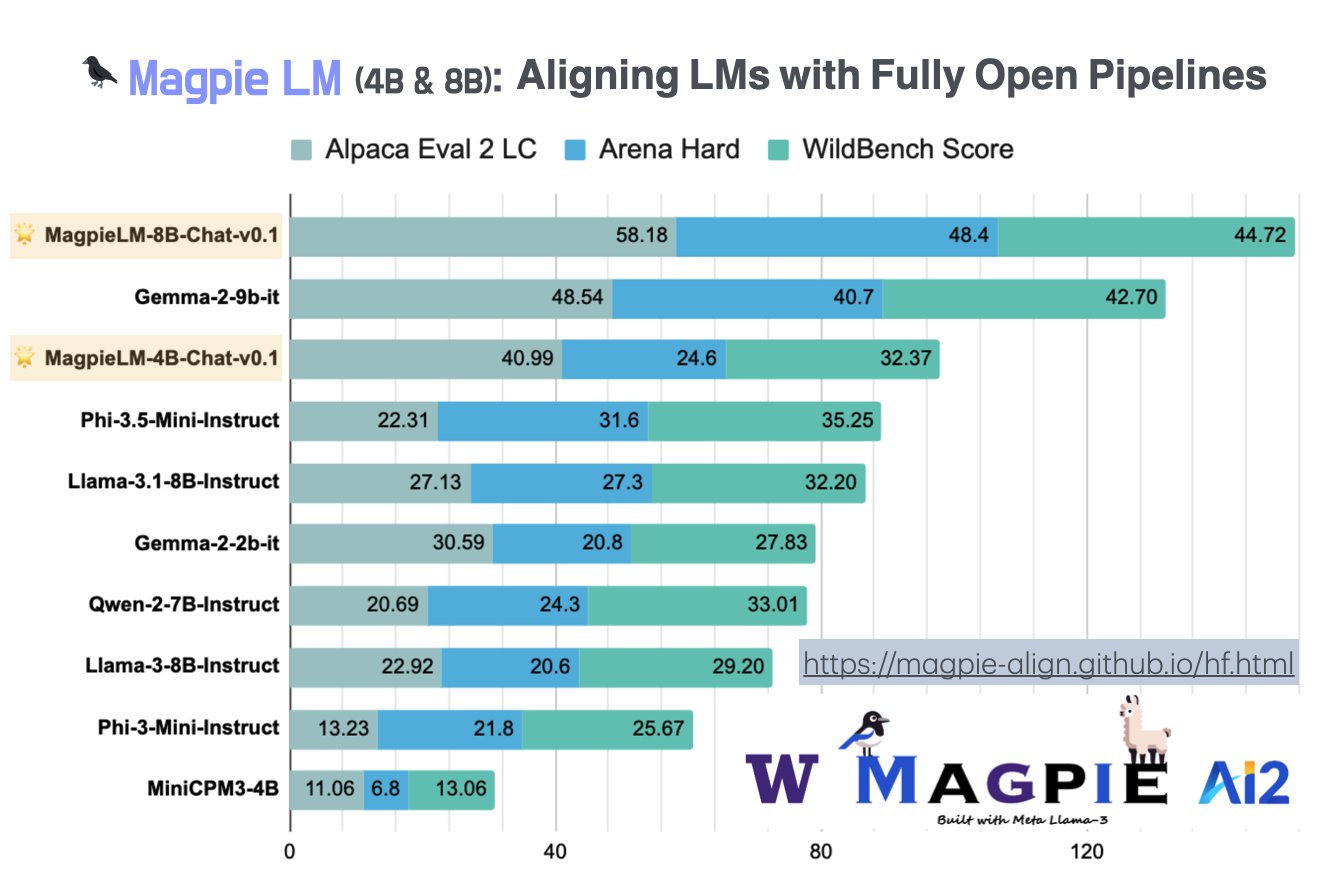

Выпуск MagpieLM-Chat является особенно значимым, поскольку модели успешно справляются с несколькими ключевыми оценочными показателями. Эти оценки включают WildBench, ArenaHard и AlpacaEval, которые оценивают, насколько хорошо языковые модели справляются с сложными задачами реального мира.

Другие Релизы: SFT-Data и DPO-Data

Помимо моделей MagpieLM-Chat, команда выпустила два крупных набора данных: MagpieLM-SFT-Dat-v0.1 и MagpieLM-DPO-Data-v0.1. Эти наборы данных представляют собой огромный ресурс для исследователей по искусственному интеллекту, заинтересованных в выравнивании и техниках постобработки.

Выравнивание После Обучения и Синтетические Данные

В центре этого релиза метод Magpie сосредотачивается на выравнивании после обучения с использованием синтетических данных. Этот процесс заключается в улучшении поведения предварительно обученной модели, такой как LLaMA, чтобы гарантировать ее соответствие человеческим целям. Пост-тренировочное выравнивание является критической частью развития современных технологий искусственного интеллекта, потому что это позволяет исследователям брать мощные многотелелесные языковые модели и настраивать их для генерации этически корректных и контекстуально подходящих результатов.

Путь Вперед: Совместимость Данных и Модели

Выход MagpieLM-Chat моделей и соответствующих наборов данных – это только начало. Команда исследователей намекнула, что будущие разработки будут сконцентрированы на совместимости данных и моделей, что является критической областью исследований в области искусственного интеллекта. Это включает в себя обеспечение совместимости данных, используемых для обучения моделей, с конкретными характеристиками самой модели, что приведет к более эффективным и эффективным процессам обучения.

Заключение

Выпуск моделей MagpieLM-Chat, в версиях 4B и 8B, является значительным шагом вперед в области согласования искусственного интеллекта. Поддержанный Университетом Вашингтона, Ai2 и NVIDIA, этот проект предоставляет высокопроизводительные, открыто доступные языковые модели и предлагает исследовательскому сообществу ценные наборы данных и инструменты для изучения сложностей выравнивания AI. С сильными результатами на знаковых оценочных показателях и приверженностью прозрачности, проект MagpieLM-Chat готов оказать влияние на будущее исследований в области согласования ИИ. Открытость моделей и данных устанавливает новый стандарт доступности в области искусственного интеллекта, делая передовые исследования в области выравнивания доступными более широкой аудитории и поощряя инновации во всей сфере.

«`