Введение в Vision Transformers (ViTs)

Vision Transformers (ViTs) произвели революцию в области компьютерного зрения благодаря своей инновационной архитектуре, использующей механизмы самовнимания для обработки изображений. В отличие от свёрточных нейронных сетей (CNN), которые полагаются на свёрточные слои для извлечения признаков, ViTs делят изображения на мелкие участки и рассматривают их как отдельные токены. Этот подход позволяет эффективно обрабатывать большие наборы данных, что делает ViTs особенно эффективными для задач классификации изображений и обнаружения объектов.

Преимущества ViTs

ViTs предоставляют гибкую структуру для решения различных задач в области компьютерного зрения, позволяя отделить поток информации между токенами от извлечения признаков внутри токенов.

Необходимость предобучения ViTs

Существует вопрос о необходимости предобучения для ViTs. Ранее считалось, что предобучение улучшает результаты на последующих задачах, обучая полезным представлениям признаков. Однако исследователи начали сомневаться, что именно эти признаки являются единственными факторами, влияющими на улучшение производительности.

Методы предобучения

Традиционные подходы к использованию предобученных ViTs включают дообучение всей модели на конкретных задачах. Это усложняет изоляцию вклада каждого элемента. Исследователи из Университета Карнеги-Меллон и FAIR предложили новый метод под названием «Передача Внимания», который позволяет изолировать и передавать только паттерны внимания из предобученных ViTs.

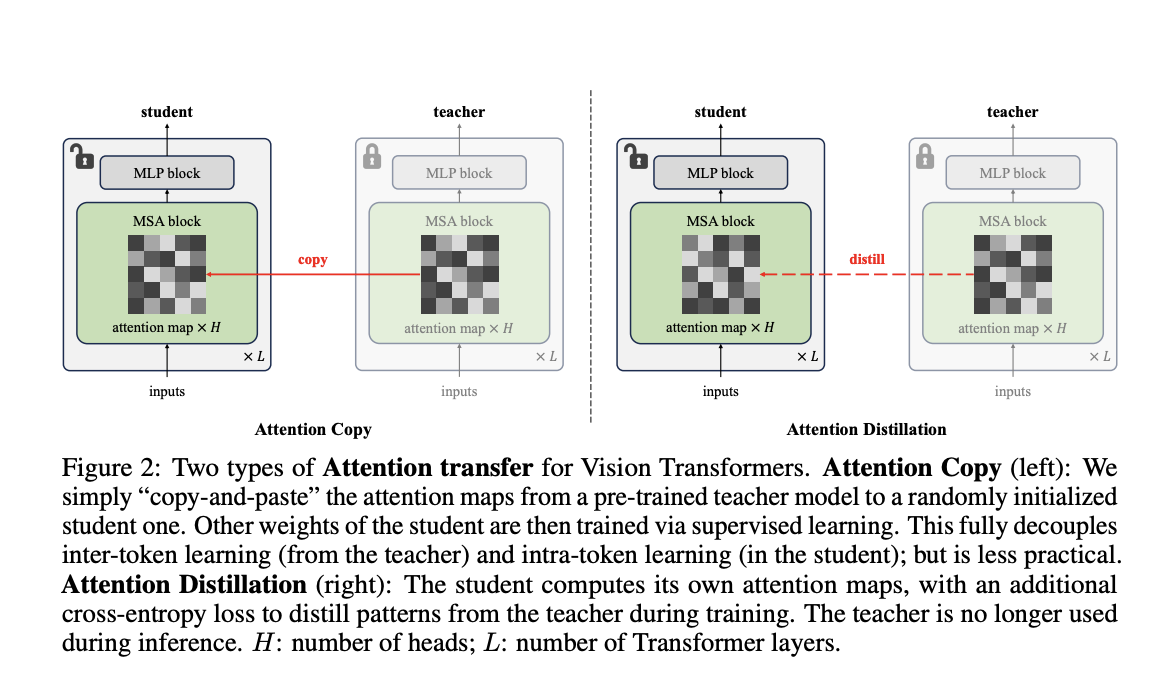

Методы передачи внимания

Метод включает два подхода: Копирование Внимания и Дистилляция Внимания. В первом случае предобученная модель генерирует карты внимания, которые применяются к модели-ученику, в то время как ученик обучается с нуля. Во втором случае используется функция потерь для обучения модели-ученика, чтобы сопоставить её карты внимания с картами учителя.

Эффективность методов

Оба метода показывают эффективность паттернов внимания в предобученных ViTs. Например, Дистилляция Внимания достигла точности 85.7% на наборе данных ImageNet-1K, что сопоставимо с полностью дообученными моделями.

Практическое применение AI

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ), рассмотрите использование метода передачи внимания. Проанализируйте, как ИИ может изменить вашу работу и где можно применить автоматизацию. Определите ключевые показатели эффективности (KPI), которые вы хотите улучшить с помощью ИИ.

Шаги по внедрению ИИ

Подберите подходящее решение и внедряйте ИИ постепенно. Начните с малого проекта, анализируйте результаты и KPI, а затем расширяйте автоматизацию на основе полученных данных.

Заключение

Изучите, как ИИ может изменить ваши процессы с решениями от Flycode.ru. Если вам нужны советы по внедрению ИИ, свяжитесь с нами.