«`html

Революционное усовершенствование Рекуррентных Нейронных Сетей (RNN): Как слои обучения во время тестирования (TTT) превосходят Трансформеры

Механизмы самовнимания способны улавливать ассоциации по всей последовательности, что делает их отличными в обработке расширенных контекстов. Однако у них высокая вычислительная стоимость, а именно квадратичная сложность, что означает, что с увеличением длины последовательности увеличивается время и объем памяти, необходимый для обработки. Рекуррентные нейронные сети (RNN), напротив, имеют линейную сложность, что повышает их вычислительную эффективность. Однако из-за ограничений, накладываемых на их скрытое состояние, которое должно содержать все данные в фиксированном представлении, RNN плохо справляются с длительными настройками.

Для преодоления этих ограничений команда исследователей из Стэнфордского университета, Университета Калифорнии в Сан-Диего, Университета Калифорнии в Беркли и Meta AI предложила уникальный класс слоев моделирования последовательностей, который объединяет более выразительное скрытое состояние с линейной сложностью RNN. Основная концепция заключается в использовании этапа обучения без учителя в качестве правила обновления и превращении скрытого состояния в модель машинного обучения. Это означает, что скрытое состояние обновляется эффективным обучением на входной последовательности, даже во время тестирования. Эти уровни называются слоями обучения во время тестирования (TTT).

TTT-Linear и TTT-MLP

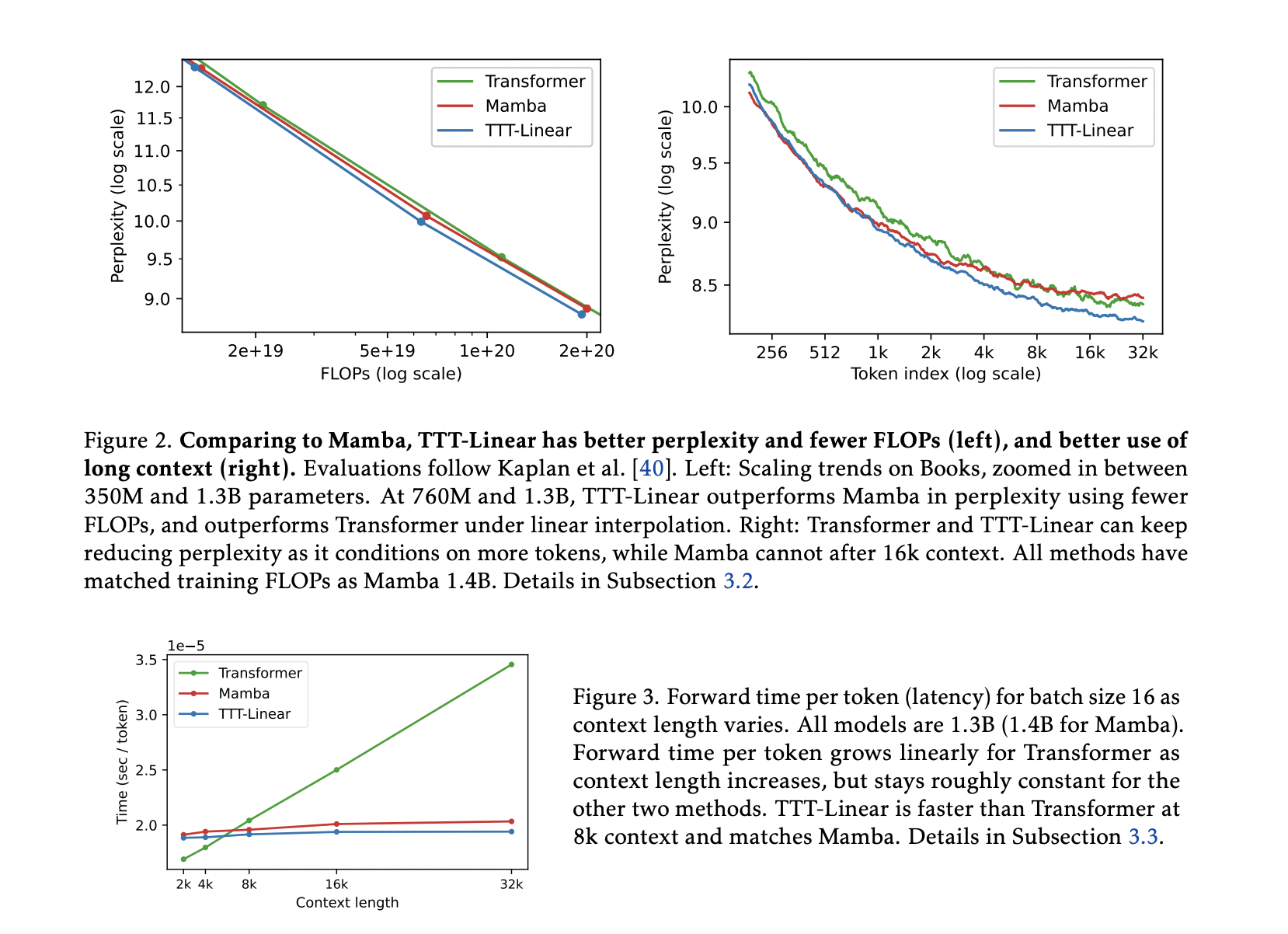

Это два различных варианта слоев TTT, которые были представлены. В то время как скрытое состояние TTT-MLP представляет собой двухслойный многослойный персептрон (MLP), скрытое состояние TTT-Linear является линейной моделью. Команда протестировала производительность этих слоев TTT по сравнению с надежной моделью Трансформера и современным RNN под названием Mamba, оценивая их на моделях с параметрами от 125 миллионов до 1,3 миллиарда.

Согласно оценкам, TTT-Linear и TTT-MLP оба работают на уровне или лучше, чем базовые модели. Аналогично Трансформеру, слои TTT продолжают уменьшаться при условии дополнительных токенов. Перплексия — это метрика, оценивающая, насколько хорошо модель предсказывает последовательность. Это большое преимущество, потому что это показывает, что слои TTT хорошо используют расширенные контексты, в то время как Mamba перестает улучшаться на 16 000 токенах.

После некоторых предварительных оптимизаций TTT-Linear сравнялся с Mamba по времени работы, что является мерой реального времени, прошедшего во время обработки, и обогнал Трансформер по скорости для последовательностей до 8 000 токенов. Хотя у TTT-MLP есть больше потенциала для управления длинными контекстами, у него все еще есть проблемы с операциями ввода/вывода памяти.

Основные вклады команды

Команда подвела итоги своих основных вкладов:

- Был представлен уникальный класс слоев моделирования последовательностей, называемых слоями обучения во время тестирования (TTT), в которых модель, обновленная с помощью обучения без учителя, служит скрытым состоянием. Это представление открывает новый путь для исследований моделирования последовательностей путем интеграции цикла обучения в прямой проход слоя.

- Была представлена простая реализация слоев TTT под названием TTT-Linear, и команда показала, что она работает лучше при оценке с размерами моделей от 125 миллионов до 1,3 миллиарда параметров, чем как Трансформеры, так и Mamba, что свидетельствует о возможности улучшения производительности моделей последовательностей с помощью слоев TTT.

- Команда также создала мини-пакет TTT и двойную форму для увеличения аппаратной эффективности слоев TTT, что делает TTT-Linear полезным строительным блоком для больших языковых моделей. Эти оптимизации делают интеграцию слоев TTT в практические приложения более реальной.

Посмотрите статью. Вся заслуга за это исследование принадлежит исследователям этого проекта. Также подписывайтесь на нас в Twitter.

Присоединяйтесь к нашему каналу в Telegram и группе в LinkedIn.

Если вам нравится наша работа, вам понравится наша рассылка.

Не забудьте присоединиться к нашему 46k+ ML SubReddit.

Статья опубликована на сайте MarkTechPost.

Революционируйте свой бизнес с помощью искусственного интеллекта (ИИ)

Если вы хотите, чтобы ваша компания развивалась с помощью искусственного интеллекта (ИИ) и оставалась в числе лидеров, грамотно используйте Revolutionizing Recurrent Neural Networks RNNs: How Test-Time Training TTT Layers Outperform Transformers.

Проанализируйте, как ИИ может изменить вашу работу. Определите, где возможно применение автоматизации: найдите моменты, когда ваши клиенты могут извлечь выгоду из AI.

Определитесь какие ключевые показатели эффективности (KPI): вы хотите улучшить с помощью ИИ.

Подберите подходящее решение, сейчас очень много вариантов ИИ. Внедряйте ИИ решения постепенно: начните с малого проекта, анализируйте результаты и KPI.

На полученных данных и опыте расширяйте автоматизацию.

Если вам нужны советы по внедрению ИИ, пишите нам на https://t.me/flycodetelegram

Попробуйте ИИ ассистент в продажах https://flycode.ru/aisales/ Этот ИИ ассистент в продажах, помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж, снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от Flycode.ru

«`