Метод IF-COMP: надежная оценка неопределенности в глубоком обучении

Метод машинного обучения, особенно глубокие нейронные сети, сосредотачивается на разработке моделей, которые точно предсказывают результаты и количественно оценивают неопределенность, связанную с этими прогнозами. Точная оценка неопределенности помогает оценить риск, связанный с использованием прогнозов модели, определяя, когда доверять решению модели и когда отменять его, что является ключевым для безопасного применения в реальных сценариях.

Проблемы существующих методов

Традиционные методы оценки неопределенности в моделях машинного обучения часто полагаются на байесовские принципы, что включает в себя определение априорного распределения и выбор из апостериорного распределения. Однако эти методы сталкиваются с существенными проблемами в глубоком обучении из-за трудностей в определении соответствующих априорных распределений и проблем масштабируемости, что затрудняет их практическое применение в крупномасштабных моделях глубокого обучения.

Решение: Метод IF-COMP

Исследовательская группа Массачусетского технологического института, Университета Торонто и Института Векторного Искусственного Интеллекта представила метод IF-COMP, который является масштабируемым и эффективным приближением распределения pNML. Данный метод позволяет генерировать откалиброванные распределения выходных данных и оценивать стохастическую сложность как для помеченных, так и для непомеченных точек данных.

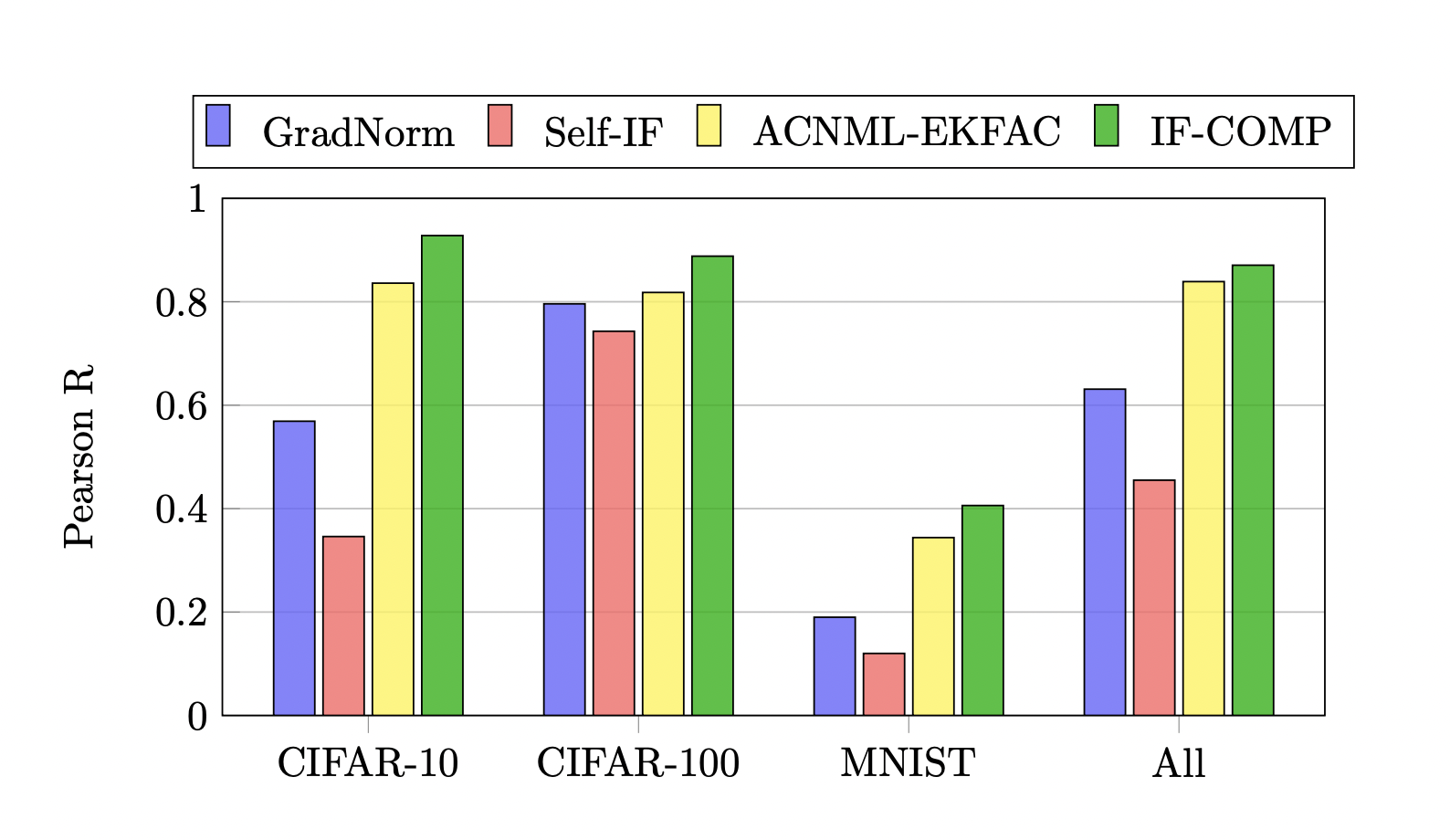

Экспериментальная проверка IF-COMP показала значительное улучшение по сравнению с существующими методами в задачах калибровки неопределенности, определения ошибок пометок и обнаружения данных вне области допустимых значений (OOD). Например, метод IF-COMP продемонстрировал превосходные результаты в задачах обнаружения ошибок пометок и внеобластных данных.

Таким образом, метод IF-COMP значительно продвигает оценку неопределенности для глубоких нейронных сетей, обеспечивая отличную производительность в различных задачах и подчеркивая свой потенциал для улучшения надежности и безопасности моделей машинного обучения в реальных приложениях.