«`html

Transformer-based Large Language Models (LLMs) в сфере обработки естественного языка (NLP)

Трансформерные модели являются основой обработки естественного языка и показывают выдающуюся производительность в различных задачах NLP. Однако у них есть ограничения, связанные с вычислительной сложностью и памятью.

Решение ограничений трансформеров

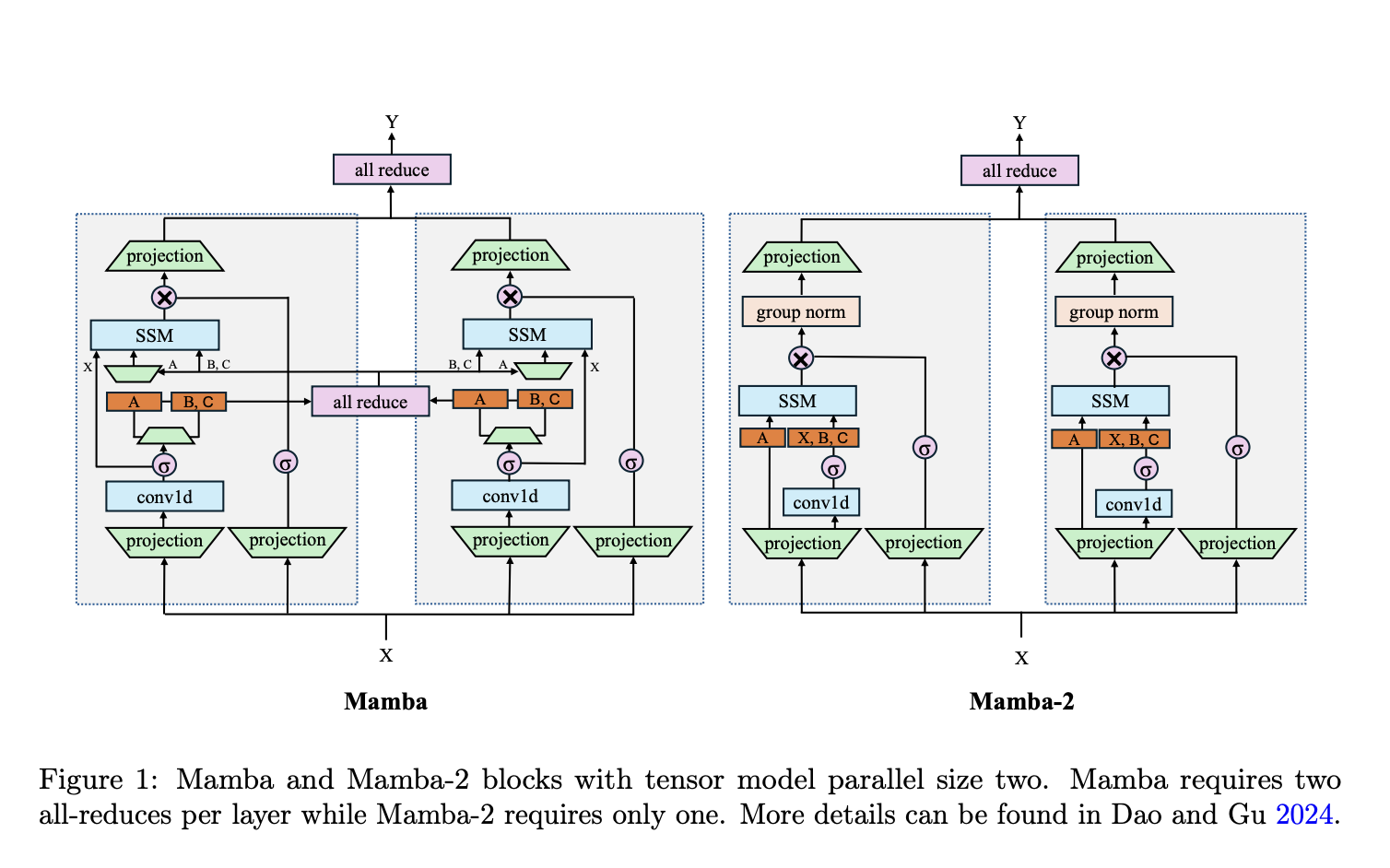

Модели с селективным пространством состояний (SSM), такие как Mamba, предлагают эффективное решение для снижения вычислительной сложности и требований к памяти. Исследования показывают, что SSM-модели могут конкурировать или превосходить трансформерные модели в задачах языкового моделирования.

Сравнение моделей

Команда исследователей провела сравнение 8-миллиардных моделей Mamba, Mamba-2 и трансформера, обученных на наборах данных до 3,5 трлн токенов. Результаты показали, что модели Mamba-2-Hybrid превзошли трансформеры на 12 стандартных задачах с улучшением в среднем на 2,65 пункта. Кроме того, гибридная модель проявила способность генерировать токены восемь раз быстрее во время вывода.

Дальнейшие исследования

Исследования были расширены для оценки возможностей длинного контекста, где гибридная модель продолжала показывать результаты на уровне или лучше трансформера в среднем по 23 дополнительным задачам. Команда выпустила код в рамках проекта NVIDIA Megatron-LM.

Применение в бизнесе

Использование ИИ-решений, таких как автоматизация, улучшение KPI и постепенное внедрение ИИ-технологий, может значительно повысить эффективность бизнес-процессов и улучшить взаимодействие с клиентами.

Если вам нужна помощь во внедрении ИИ-решений, пишите нам на Telegram.

Попробуйте ИИ-ассистент в продажах здесь. Этот ИИ-ассистент помогает отвечать на вопросы клиентов, генерировать контент для отдела продаж и снижать нагрузку на первую линию.

Узнайте, как ИИ может изменить ваши процессы с решениями от Flycode.ru.

«`