Продвижение ИИ в области психического здоровья с помощью легкого, экспертно знанием наполненного трансформера для низкоресурсных сред

Психическое здоровье глубоко влияет на качество жизни людей, но доступ к психической помощи может быть затруднен из-за стигматизации, недостаточности кадров и фрагментированных систем ухода. Исследования показали потенциал NLP в этой области, с моделями, разработанными для обнаружения симптомов и оценки депрессии из клинических текстов. Однако создание этих моделей требует значительной вычислительной мощности, которой многим организациям не хватает, а также регулирования, такие как HIPAA и GDPR, дополнительно усложняют использование облачных ресурсов.

Практические решения и ценность

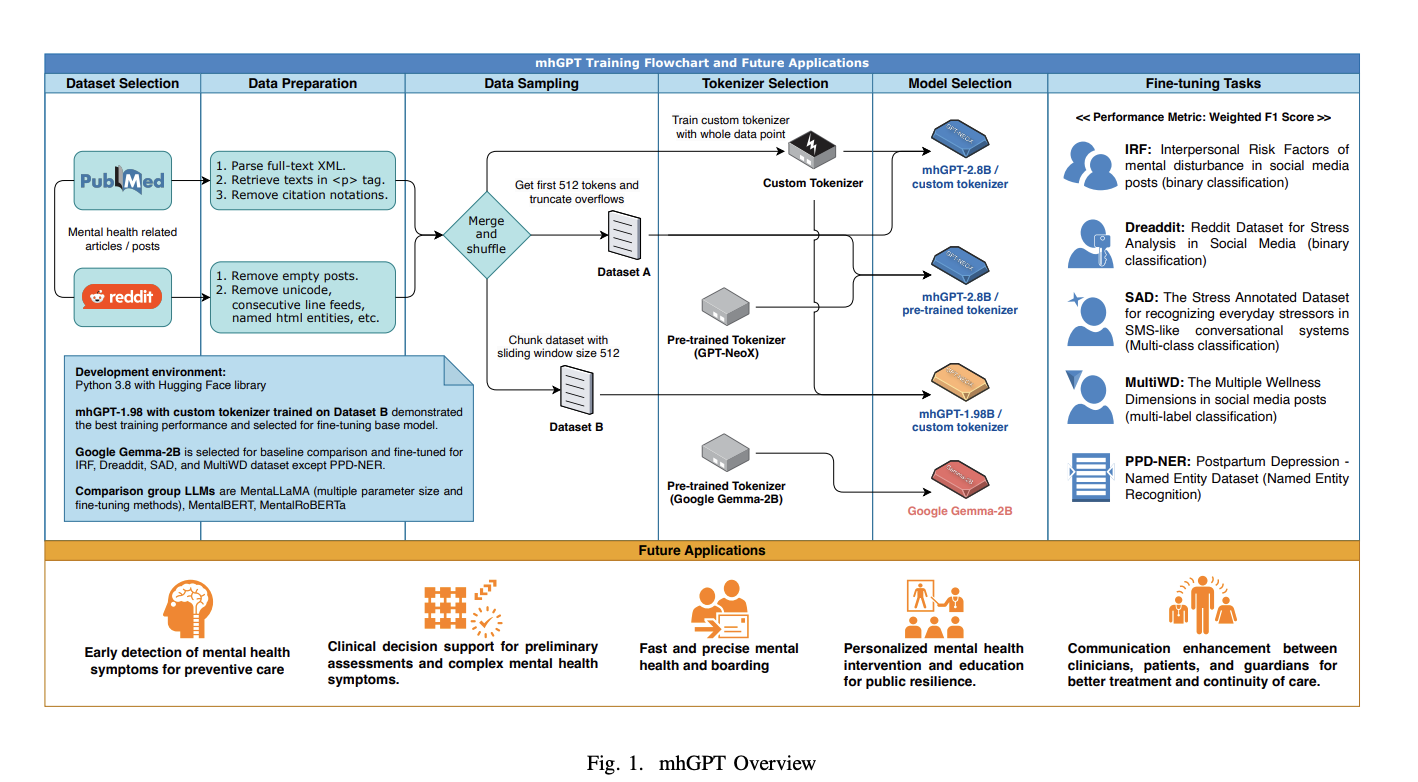

Исследователи детской больницы и университета Джорджа Вашингтона представили mhGPT, легкую генеративную модель, обученную на связанных с психическим здоровьем социальных медиа и статьях PubMed. Разработанный для условий с ограниченными ресурсами, mhGPT с всего 1,98 миллиардами параметров превзошел более крупные модели, такие как MentaLLaMA и Gemma, несмотря на использование всего 5% набора данных. Модель получила преимущества от интеграции разнообразных данных о психическом здоровье и специального токенизатора, показав, что меньшие модели, наполненные экспертными знаниями, могут соответствовать или превзойти производительность передовых моделей в задачах психического здоровья, даже при ограниченных вычислительных ресурсах.

Несколько исследований разработали модели LLM для психического здоровья, в основном обучая их на данных из социальных медиа. MentaLLaMA, обученная на интерпретируемом наборе данных по инструкциям психического здоровья, улучшает анализ психического здоровья с нулевым/малым количеством образцов. MentalBERT сосредотачивается на раннем выявлении психических расстройств и суицидальных намерениях из социального контента, превзойдя общие языковые модели в этой области. Кроме того, настроенные модели BERT на данных ЭМК для конкретных психических расстройств показывают преимущества передачи знаний в конкретной области. Настройка остается важной для улучшения производительности LLM, с методами, такими как LoRA и QLoRA, обеспечивающими эффективную настройку в условиях ограниченных ресурсов путем снижения использования памяти и времени обучения.

Исследование использовало 49 812 статей PubMed Central по психическому здоровью и более 1 миллиона постов и комментариев Reddit из различных подразделов, посвященных психическому здоровью. Данные были предварительно обработаны путем удаления нерелевантного контента, а затем отобраны с использованием двух методов: обрезка до 512 токенов или разделение с помощью скользящего окна. Обучение включало три конфигурации с использованием архитектуры GPT-NeoX с различными размерами параметров и токенизаторов. Модели обучались на высокопроизводительных вычислительных кластерах и экземплярах Amazon EC2. Для улучшения настройки использовались техники LoRA и QLoRA, а NEFTune применялась для смягчения переобучения, особенно в дисбалансированных наборах данных.

Исследование показало, что mhGPT превзошел сравнимые модели, такие как MentaLLaMA, MentalBERT и MentalRoBERTa в различных задачах, несмотря на то, что эти модели обучались на более крупных наборах данных. mhGPT превзошел человеческих аннотаторов в задаче распознавания именованных сущностей (NER). Базовая модель, Gemma-2В, хорошо справилась с бинарной и многоклассовой классификацией, но может иметь недостаточную интерпретируемость в контекстах психического здоровья. NEFTune улучшила настройку на малых, дисбалансированных наборах данных, позволив mhGPT превзойти более крупные модели, такие как MentaLLaMA-7В. Модели A и B также показали сильную производительность в конкретных задачах классификации.

В заключение, mhGPT — это компактный генеративный предварительно обученный трансформер, разработанный для анализа текста о психическом здоровье. Обученный на связанных с психическим здоровьем социальных медиа и статьях PubMed, mhGPT был настроен на пять конкретных задач и превзошел передовые модели, такие как MentaLLaMA, несмотря на меньшее количество параметров и данных обучения. Ключевые инновации включают использование экспертно знанием наполненных данных, специального токенизатора и NEFTune для улучшения производительности на дисбалансированных наборах данных. Исследование демонстрирует потенциал mhGPT в улучшении ИИ в области психического здоровья, особенно в условиях ограниченных ресурсов путем оптимизации архитектуры более маленькой модели.

Проверьте статью. Вся заслуга за это исследование принадлежит исследователям этого проекта.