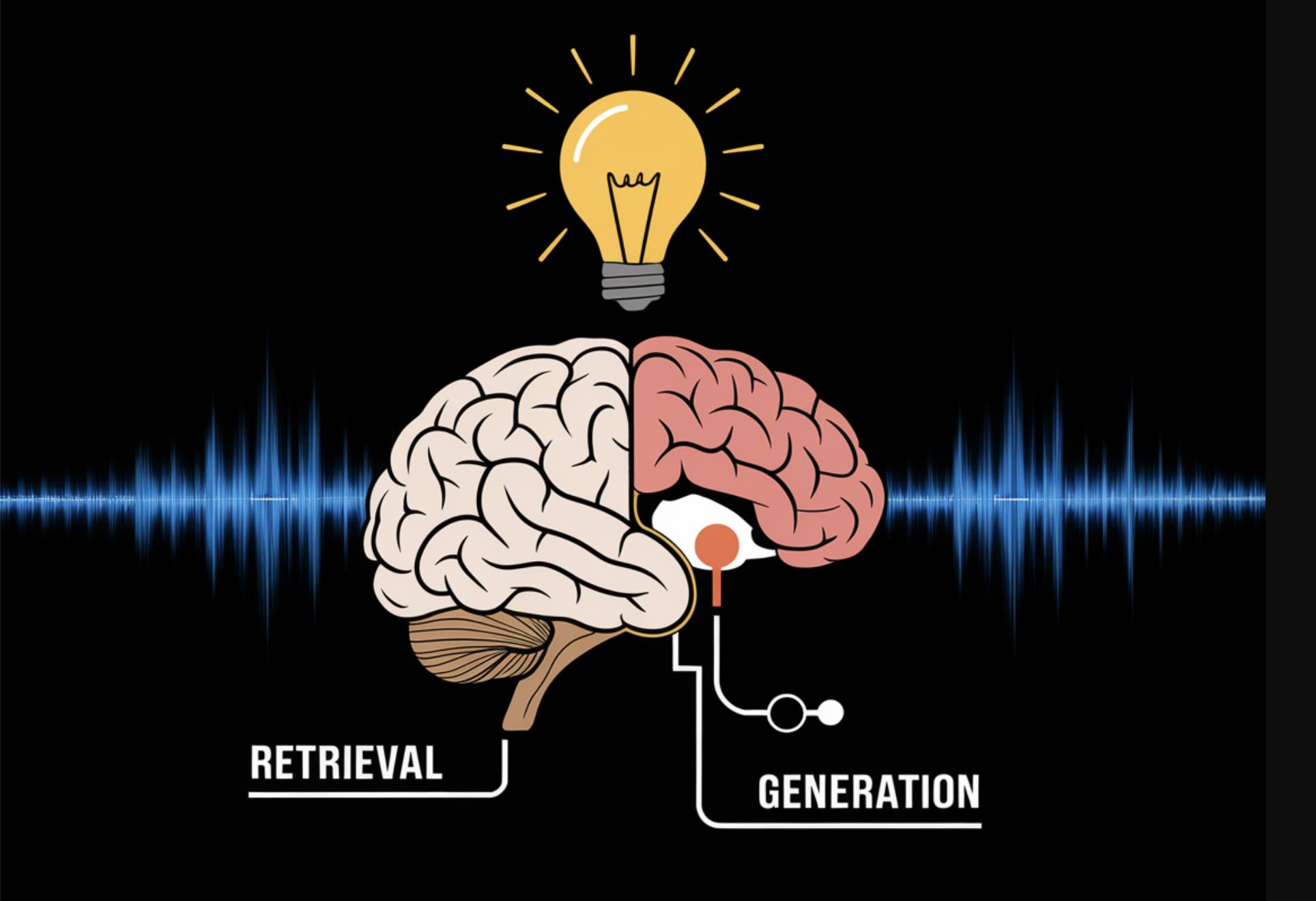

Архитектура RAG

RAG использует внешние базы знаний для оптимизации вывода больших языковых моделей (LLM), что позволяет создавать более точный и актуальный текст. Комбинация возможностей LLM с традиционными системами информационного поиска, такими как базы данных, обеспечивает AI возможность писать более точные и релевантные тексты.

Применение RAG в реальных задачах

RAG находит широкое применение в различных областях, улучшая системы вопросов и ответов, упрощая создание контента, улучшая чат-ботов и виртуальных помощников, а также помогая в поиске знаний, образовательных инструментах и юридических исследованиях.

Основные проблемы

Несмотря на мощность RAG, существуют ограничения, такие как сложности с интеграцией сторонних источников данных, проблемы с конфиденциальностью и соответствием, задержки в ответе из-за объема данных и надежности источников данных.

Будущие тенденции

Будущее RAG связано с развитием мультимодальных систем, способных работать с различными типами данных, что позволит использовать AI в более широком спектре отраслей.