Революционное решение для улучшения производительноси AI

Одной из ключевых проблем моделей Retrieval-Augmented Generation (RAG) является эффективное управление длинными контекстуальными входами. Решение этой проблемы критически важно для развития искусственного интеллекта и повышения его практичности.

Решение проблемы

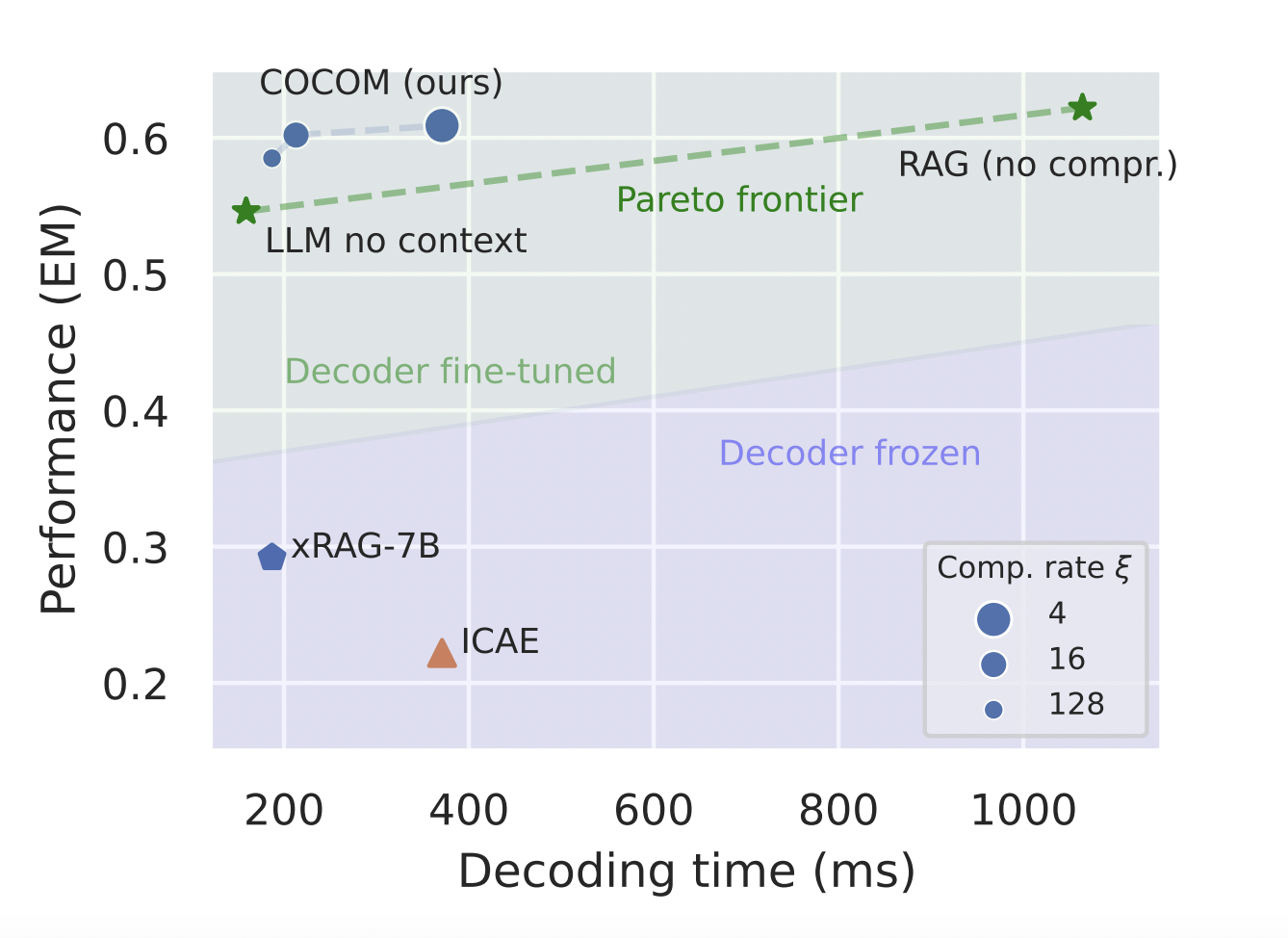

COCOM (COntext COmpression Model) представляет собой новый и эффективный метод сжатия контекста, который позволяет значительно ускорить время генерации ответов при сохранении высокой производительности. Метод COCOM обеспечивает различные уровни сжатия, находя баланс между временем декодирования и качеством ответов.

Технические аспекты

COCOM демонстрирует значительное увеличение эффективности декодирования и производительности по сравнению с другими методами сжатия контекста. Например, при коэффициенте сжатия 4 на наборе данных Natural Questions, COCOM достигает точности Exact Match (EM) в 0,554, а на TriviaQA — в 0,859, превосходя другие методы.

Завершение

COCOM представляет значительный прогресс в сжатии контекста для моделей RAG, позволяя уменьшить время декодирования и поддерживать высокую производительность. Это решение имеет потенциал значительно улучшить практическое применение LLMs в реальных сценариях искусственного интеллекта, преодолевая некоторые критические препятствия.

Если вы заинтересованы в реализации подобных решений искусственного интеллекта, обратитесь к нашей команде по ссылке: https://t.me/flycodetelegram

Попробуйте внедрить ИИ ассистента в продажах от Flycode.ru: https://flycode.ru/aisales/