Генеративный искусственный интеллект (Gen AI)

Генеративный искусственный интеллект (Gen AI), способный создавать качественный контент на основе входных данных, готов оказать влияние на различные секторы, такие как наука, экономика, образование и окружающая среда. Обширные социотехнические исследования направлены на понимание широких последствий, учитывая риски и возможности. Дебаты ведутся вокруг открытости моделей Gen AI, приверженцы которой выступают за их открытое распространение для общей пользы. Регулятивные изменения, в частности, Акт об искусственном интеллекте ЕС и Указ президента США, подчеркивают необходимость оценки рисков и возможностей, в то время как вопросы, касающиеся управления и системных рисков, остаются нерешенными.

Открытое распространение генеративного искусственного интеллекта

Дискуссии о открытом распространении генеративного искусственного интеллекта являются сложными и включают в себя изучение широких последствий и конкретных дебатов. Исследования затрагивают преимущества и риски в различных областях, таких как наука и образование, а также последствия сдвигов в возможностях. Обсуждения сосредотачиваются на классификации систем на основе уровней раскрытия и обеспечения безопасности искусственного интеллекта. В то время как закрытые модели по-прежнему превосходят открытые, разрыв сокращается.

Рекомендации для разработчиков и законодателей

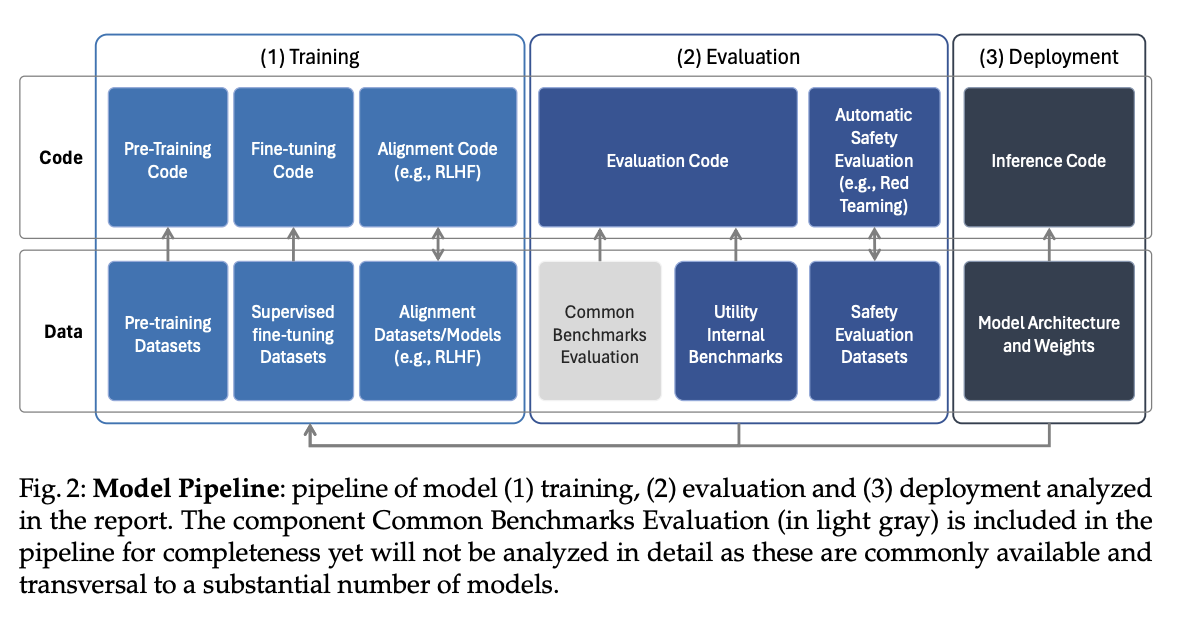

Исследователи предлагают классификационную шкалу для оценки открытости компонентов генеративных AI-конвейеров. Компоненты категоризируются как полностью закрытые, полуоткрытые или полностью открытые на основе доступности. Система оценки на основе баллов оценивает лицензии, различая между высокими ограничениями и свободными ограничениями. Анализ применяется к 45 высокоэффективным моделям больших языковых моделей (LLM), выявляя баланс между открытыми и закрытыми компонентами. Исследование принимает социотехнический подход, рассматривая влияние автономных открытых генеративных моделей AI по сравнению с закрытыми в ключевых областях. Очень важно подчеркнуть важность воспроизводимости в разработке моделей.

Заключение

Сужение разрыва в производительности между закрытыми и открытыми моделями Gen AI подогревает дебаты о наилучших практиках для открытого распространения с целью смягчения рисков. Обсуждения фокусируются на классификации систем на основе готовности к раскрытию и их дифференциации для регулятивной ясности. Озабоченность безопасностью искусственного интеллекта усиливается, подчеркивая необходимость открытых моделей для смягчения рисков централизации, признавая увеличенный потенциал злоупотребления. Авторы предлагают надежную таксономию и предлагают тонкие аналитические выводы о рисках в ближайшем, среднесрочном и долгосрочном периодах, расширяя предыдущие исследования с обширными рекомендациями для разработчиков.