«`html

Метод Branch-and-Merge: улучшение адаптации языка в моделях ИИ путем смягчения катастрофического забывания и обеспечения сохранения базовых языковых возможностей при изучении новых языков

Адаптация языковой модели — важная область искусственного интеллекта, направленная на улучшение работы больших предварительно обученных языковых моделей для эффективной работы на различных языках. Это исследование важно для того, чтобы эти модели могли понимать и генерировать текст на нескольких языках, что необходимо для глобальных приложений ИИ. Несмотря на впечатляющую производительность LLM на английском языке, их возможности значительно снижаются при адаптации к менее распространенным языкам, что делает необходимыми дополнительные методы адаптации.

Решение проблемы катастрофического забывания

Одной из значительных проблем в адаптации языковых моделей к новым языкам является катастрофическое забывание. Это происходит, когда модель теряет свою профессиональную подготовку в оригинальном языке при изучении нового, серьезно ограничивая ее полезность. Сохранение возможностей базовой модели важно для решения задач на новом языке, поскольку навыки, такие как математика и программирование, изученные на английском, бесценны для решения проблем и рассуждений на других языках.

Метод Branch-and-Merge (BAM)

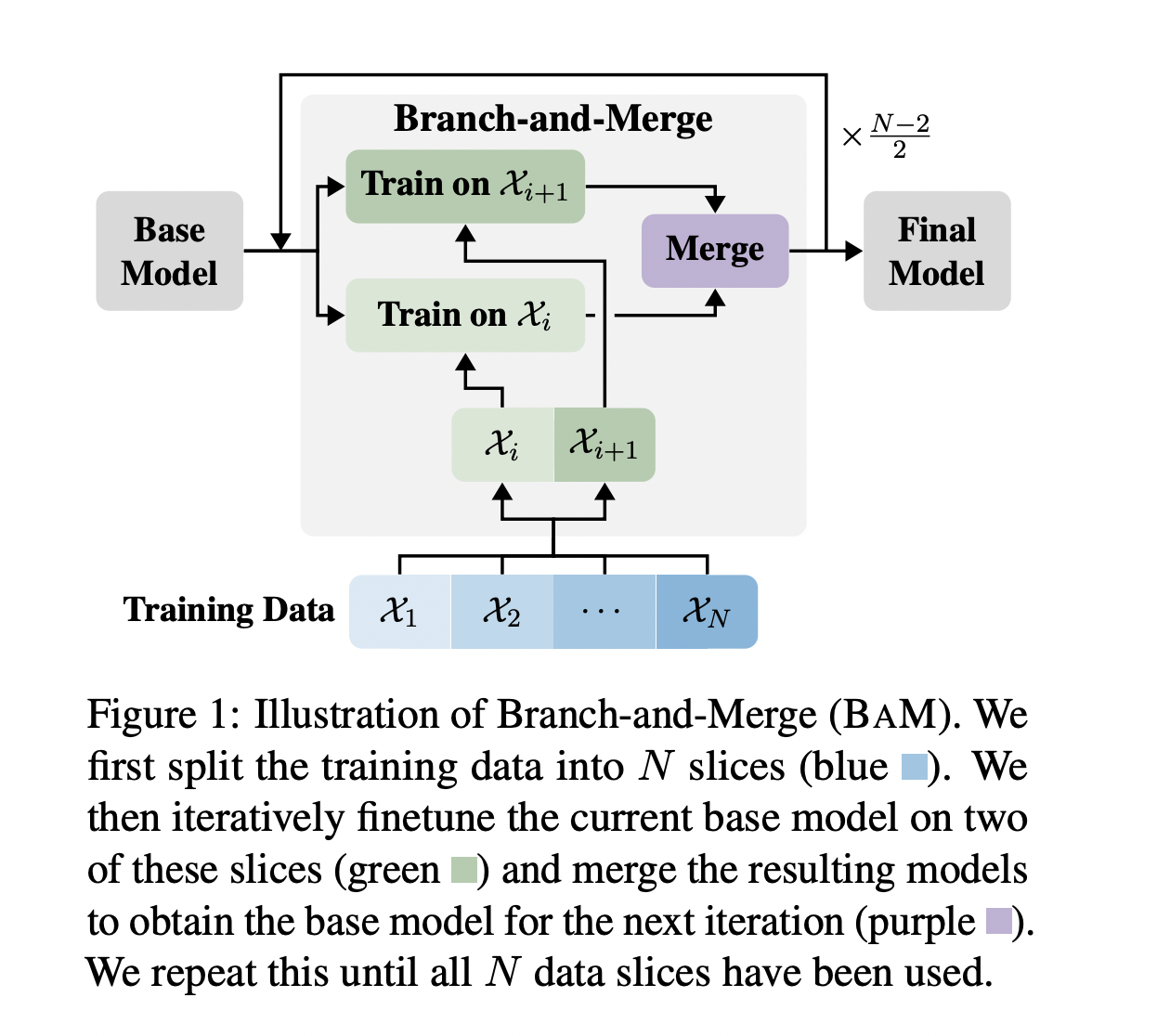

Исследователи из INSAIT, LogicStar.ai, ETH Zurich, Университета Чикаго и Together AI представили новый подход под названием Branch-and-Merge (BAM). Этот метод итеративно объединяет несколько моделей, каждая из которых донастраивается на различных подмножествах обучающих данных, чтобы достичь более низких, но более качественных изменений веса. Путем объединения этих моделей BAM снижает забывание, сохраняя при этом эффективность обучения. Метод BAM разделяет обучающие данные на несколько срезов и параллельно донастраивает базовую модель на этих срезах. Полученные модели объединяются для формирования новой базовой модели для следующей итерации. Этот итеративный процесс минимизирует общее изменение веса, снижая риск катастрофического забывания. Кроме того, используя несколько обучающих срезов, BAM обеспечивает сохранение важных навыков из базового языка.

Результаты исследования

Исследование показало, что BAM значительно снижает забывание, соответствуя или улучшая производительность в целевой области по сравнению со стандартными методами обучения. Например, модель LLAMA-3-8B, обученная с помощью BAM, улучшила производительность в болгарских задачах на 10,9% и в английских задачах на 1,3%, что демонстрирует эффективность метода.

Эффективность BAM

Эффективность BAM также была продемонстрирована при настройке инструкций. Используя 928 000 образцов данных настройки инструкций на английском языке, смешанных с данными на немецком или болгарском языке, BAM незначительно улучшил обучение в обеих целевых языках, существенно снижая забывание.

Заключение

Метод Branch-and-Merge (BAM) предлагает надежное решение для катастрофического забывания при адаптации языковых моделей. Обеспечение минимальных, но эффективных изменений веса сохраняет возможности модели на оригинальном языке, улучшая ее производительность на целевом языке. Этот подход может значительно помочь практикующим, работающим над многоязычными приложениями ИИ, предоставляя более эффективный способ адаптации больших языковых моделей к разнообразным языковым средам.

«`