«`html

Microsoft расширила свои возможности в области искусственного интеллекта, представив три новых модели: Phi 3.5 Mini Instruct, Phi 3.5 MoE (Mixture of Experts) и Phi 3.5 Vision Instruct.

Phi 3.5 Mini Instruct: Баланс мощности и эффективности

Модель Phi 3.5 Mini Instruct — это плотная модель декодера Transformer только с 3,8 миллиардами параметров, обладающая впечатляющей длиной контекста в 128 тыс. токенов. Это позволяет модели управлять задачами, связанными с длинными документами, развернутыми разговорами и сложными сценариями рассуждений. Модель обучена на разнообразном наборе данных объемом 3,4 триллиона токенов и показывает высокую производительность в задачах рассуждений, математического решения проблем и логического вывода.

Phi 3.5 MoE: Разблокирование потенциала Mixture of Experts

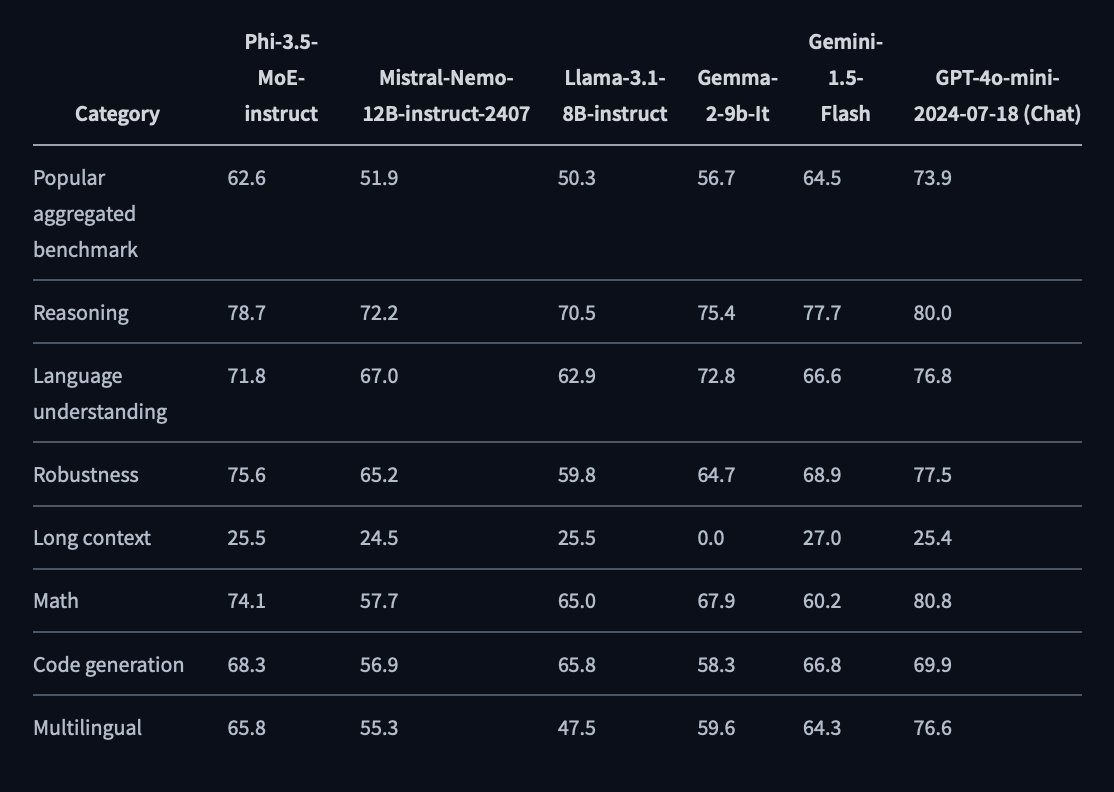

Модель Phi 3.5 MoE представляет собой значительный скачок в архитектуре искусственного интеллекта с дизайном Mixture of Expert. Модель обучена на 4,9 триллиона токенов и обладает возможностью обрабатывать до 128 тыс. токенов в одном контексте. Это делает ее подходящей для суммирования документов, юридического анализа и развернутых систем диалога.

Phi 3.5 Vision Instruct: Пионер в области мультимодального ИИ

Модель Phi 3.5 Vision Instruct — это мультимодальный ИИ, обрабатывающий задачи, требующие текстовых и визуальных данных. Модель обладает 4,15 миллиардами параметров и длиной контекста в 128 тыс. токенов, что позволяет ей отлично справляться с задачами мульти-изображений, анализа графиков и таблиц, а также суммирования видеороликов.

«`