AI21 Labs Released Jamba 1.5 Family of Open Models: Jamba 1.5 Mini and Jamba 1.5 Large

AI21 Labs сделала значительный шаг в области искусственного интеллекта, выпустив семейство открытых моделей Jamba 1.5, включающее Jamba 1.5 Mini и Jamba 1.5 Large. Эти модели, построенные на новой архитектуре SSM-Transformer, представляют собой прорыв в технологии искусственного интеллекта, особенно в обработке задач с длинным контекстом. AI21 Labs стремится демократизировать доступ к этим мощным моделям, выпустив их под лицензией Jamba Open Model, поощряя широкое экспериментирование и инновации.

Основные особенности моделей Jamba 1.5

Одной из выдающихся особенностей моделей Jamba 1.5 является их способность обрабатывать исключительно длинные контексты. Они обладают эффективным окном контекста из 256 тыс. токенов, самым длинным на рынке среди открытых моделей. Эта функция критически важна для предприятий, требующих анализа и резюмирования длинных документов. Модели также отлично справляются с агентными и Retrieval-Augmented Generation (RAG) рабочими процессами, улучшая как качество, так и эффективность этих процессов.

Скорость и качество

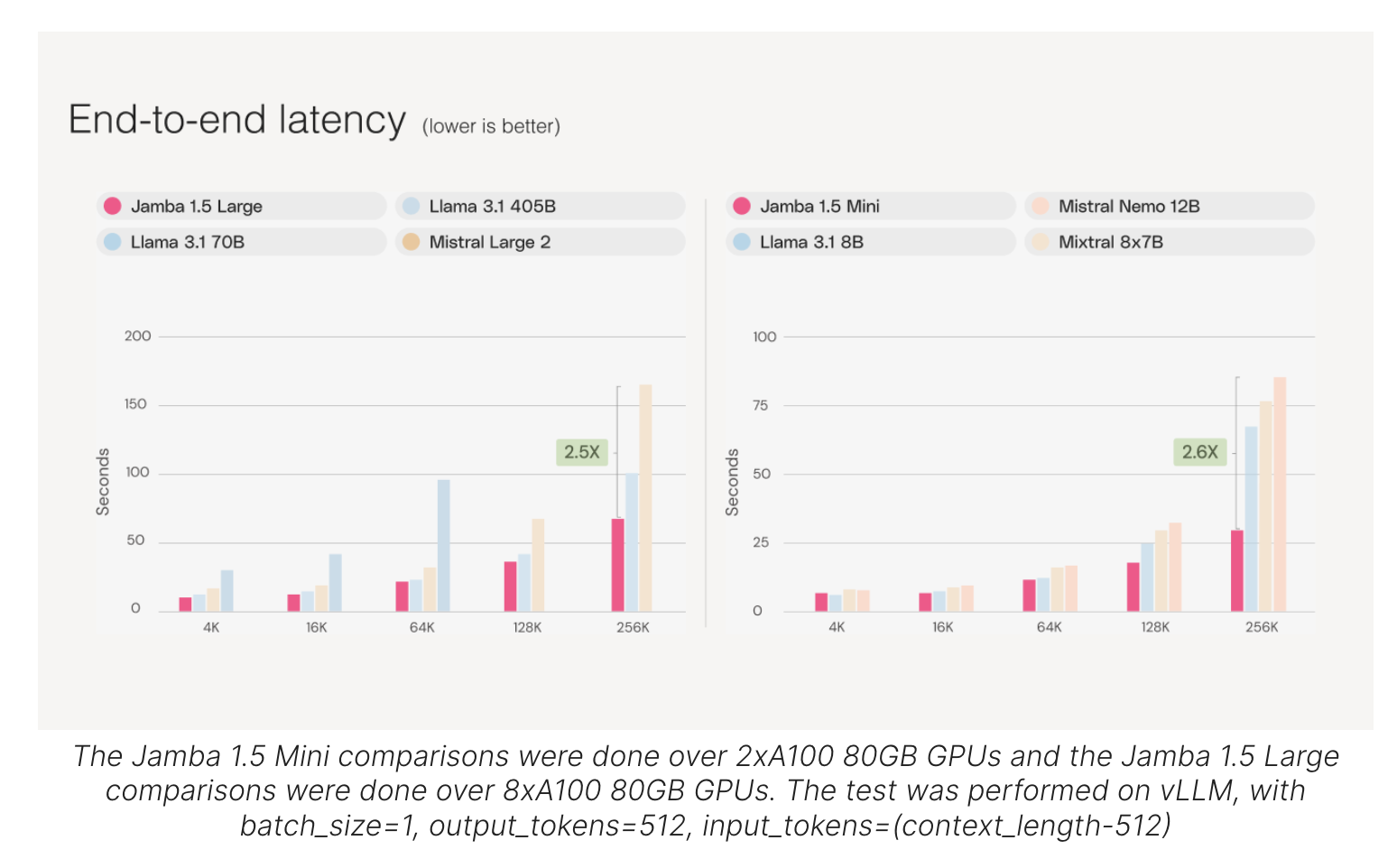

По скорости модели Jamba 1.5 в 2,5 раза быстрее на длинных контекстах по сравнению с конкурентами, и они поддерживают превосходную производительность на всех длинах контекста в своем классе. Это преимущество скорости критически важно для предприятий, которым требуются быстрые сроки выполнения задач, таких как поддержка клиентов или обработка данных в масштабе.

Качество моделей Jamba 1.5 — еще одна область, где они превосходят своих конкурентов. Jamba 1.5 Mini признана самой мощной открытой моделью в своем классе, достигнув оценки 46,1 по бенчмарку Arena Hard, превзойдя более крупные модели, такие как Mixtral 8x22B и Command-R+. Jamba 1.5 Large идет еще дальше, набрав 65,4, что превосходит ведущие модели, такие как Llama 3.1 70B и 405B. Это высококачественное выполнение по различным бенчмаркам подчеркивает надежность моделей Jamba 1.5 в предоставлении надежных и точных результатов.

Многоязычная поддержка и готовность разработчиков

Помимо их технической мощи, модели Jamba 1.5 разработаны с многоязычной поддержкой, охватывая языки, такие как испанский, французский, португальский, итальянский, голландский, немецкий, арабский и иврит. Это делает их универсальными инструментами для глобальных предприятий, работающих в разноязычных средах.

Для разработчиков модели Jamba 1.5 предлагают нативную поддержку структурированного JSON-вывода, вызов функций, обработку объектов документов и генерацию цитат. Эти функции делают модели адаптивными к различным потребностям разработки, обеспечивая безшовную интеграцию в существующие рабочие процессы.

Развертывание и эффективность

AI21 Labs обеспечила доступность и возможность развертывания моделей Jamba 1.5 на нескольких платформах. Они доступны для немедленной загрузки на Hugging Face и поддерживаются крупными облачными провайдерами, включая Google Cloud Vertex AI, Microsoft Azure и NVIDIA NIM. Ожидается, что модели скоро будут доступны на дополнительных платформах, таких как Amazon Bedrock, Databricks Marketplace, Snowflake Cortex и других, что делает их легко развертываемыми в различных средах, включая локальные и виртуальные частные облака.

Еще одним критическим преимуществом моделей Jamba 1.5 является их ресурсная эффективность. Построенные на гибридной архитектуре, объединяющей преимущества архитектур Transformer и Mamba, эти модели предлагают более низкий объем памяти, позволяя предприятиям обрабатывать обширные контексты на одном графическом процессоре. Новая техника квантования AI21 Labs, ExpertsInt8, дополнительно улучшает эту эффективность, оптимизируя производительность модели без ущерба для качества.

Заключение

Выпуск семейства Jamba 1.5 AI21 Labs является значительным прорывом в обработке длинных контекстов. Эти модели устанавливают новые стандарты в скорости, качестве и эффективности, демократизируя доступ к передовой технологии искусственного интеллекта через свою открытую модельную лицензию. Поскольку предприятия продолжают искать ИИ-решения, способные приносить реальную ценность, модели Jamba 1.5 выделяются как мощные инструменты, способные удовлетворить потребности сложных крупномасштабных приложений. Их доступность на различных платформах и поддержка многоязычных сред дополнительно усиливают их привлекательность, делая их универсальным выбором для разработчиков и бизнеса.