Применение искусственного интеллекта (ИИ) в многоязычных средах

Проблема:

Высокое время вывода является основной проблемой при использовании крупных языковых моделей (LLMs) в многоязычных контекстах.

Решение:

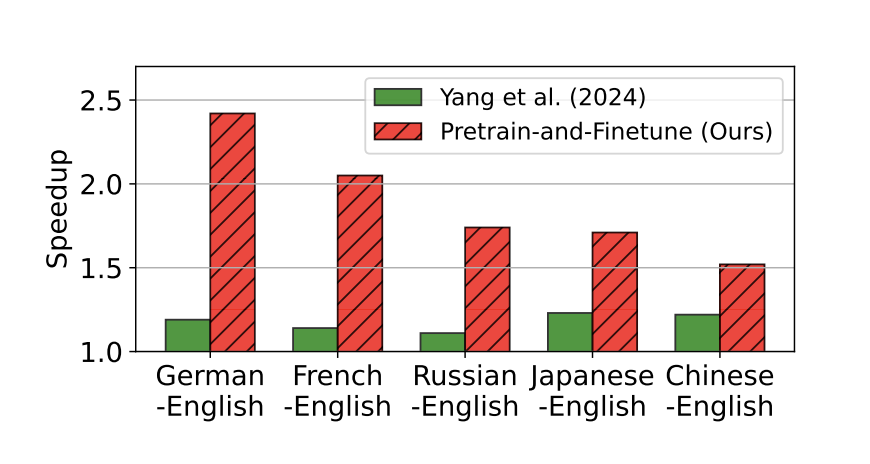

Исследователи из KAIST AI и KT Corporation предложили инновационный подход к многоязычному спекулятивному декодированию, используя стратегию предварительного обучения и донастройки.

Преимущества:

Этот подход значительно сокращает время вывода и улучшает производительность на задачах перевода между такими языковыми парами, как немецкий-английский и французский-английский.

Значение:

Предложенная методология устанавливает новый стандарт для практического применения LLMs в разнообразных языковых средах, обеспечивая более точные и быстрые результаты.

Практические рекомендации:

Используйте специализированные модели-черновики для улучшения эффективности вывода LLMs в многоязычных приложениях. Начните с малых проектов, анализируйте результаты и постепенно масштабируйте автоматизацию.