Эффективное управление длинными контекстами в обработке естественного языка

Обработка длинных текстов является сложной задачей в области обработки естественного языка. Модели, способные читать и генерировать текст, сталкиваются с проблемами при анализе больших объемов информации. Например, при работе с длинными документами или большими кодовыми репозиториями вычислительные затраты могут стать слишком высокими.

Проблемы традиционного подхода

Существующие методы часто используют фиксированные структуры, что может снижать качество. Например, механизмы скользящего окна ограничивают токены определенной областью, игнорируя важные глобальные связи. Это требует значительных затрат на переобучение моделей.

Решение от Moonshot AI

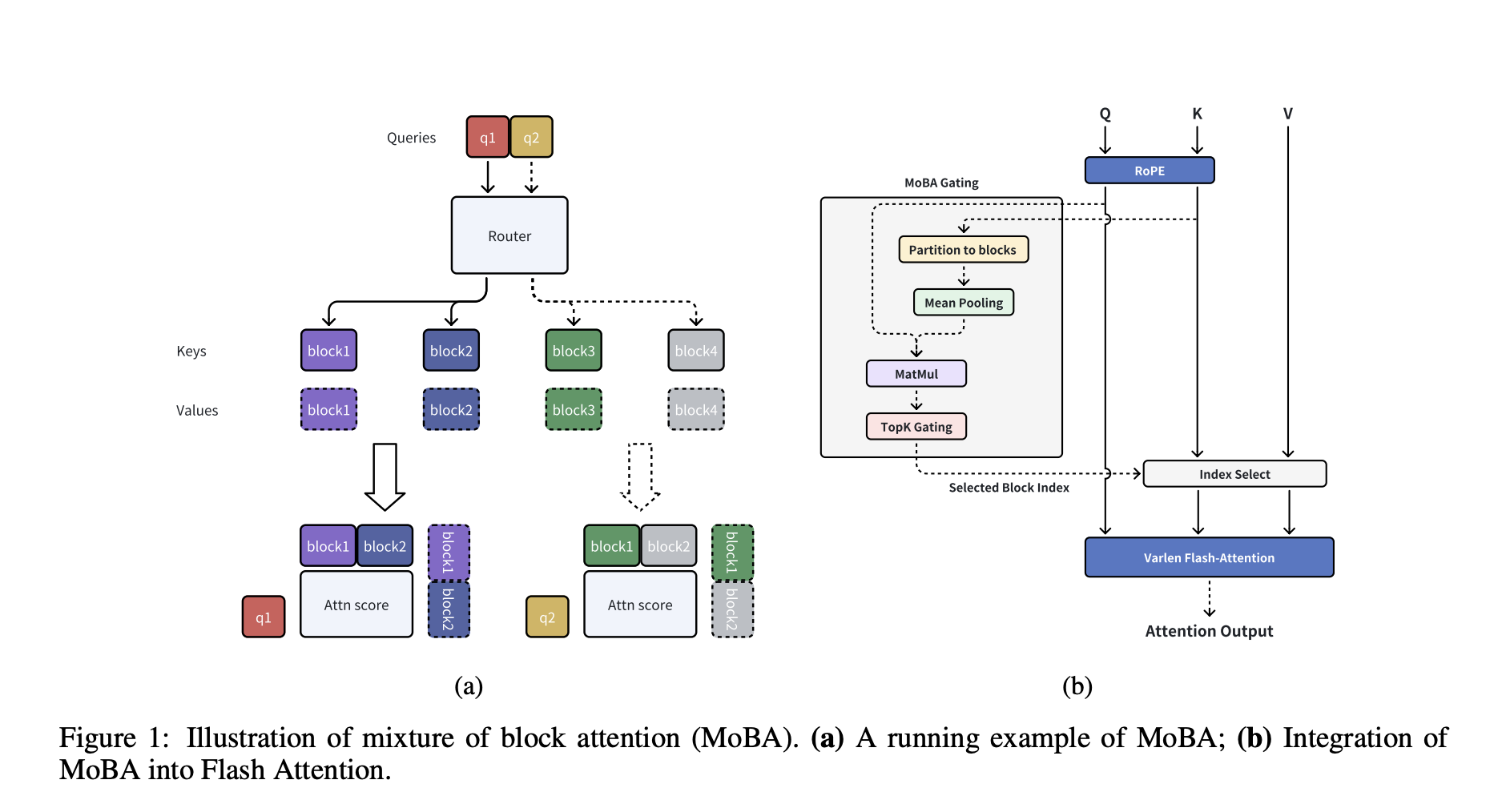

Исследователи из Moonshot AI представили новый подход под названием Mixture of Block Attention (MoBA). Этот метод разбивает входные данные на управляемые блоки и использует обучаемую систему для определения, какие блоки важны для каждого токена запроса. Это позволяет модели эффективно сравнивать токены, не теряя при этом важную информацию.

Преимущества MoBA

MoBA легко интегрируется с существующими моделями Transformer и сохраняет количество параметров на прежнем уровне. Это позволяет использовать как разреженное, так и полное внимание, что значительно ускоряет обработку длинных входов.

Технические детали и выгоды

MoBA делит контекст на блоки и вычисляет «связь» между токеном запроса и каждым блоком. Это позволяет сосредоточиться только на самых релевантных токенах. Такой подход значительно снижает вычислительные затраты, особенно при работе с длинными последовательностями.

Результаты и инсайты

Тесты показывают, что MoBA обеспечивает производительность на уровне полного внимания, при этом значительно экономя вычислительные ресурсы. Это делает его идеальным для задач, требующих обработки длинного контекста, таких как понимание текста или многослойные диалоговые системы.

Заключение

Mixture of Block Attention (MoBA) предлагает эффективное решение для обработки длинных контекстов без значительных изменений в архитектуре Transformer. Этот метод позволяет моделям лучше справляться с большими объемами данных, сохраняя при этом высокую производительность.

Как использовать ИИ в вашей компании

Если вы хотите, чтобы ваша компания развивалась с помощью ИИ, рассмотрите следующие шаги:

- Проанализируйте, как ИИ может изменить вашу работу и где его можно применить.

- Определите ключевые показатели эффективности (KPI), которые хотите улучшить с помощью ИИ.

- Выберите подходящее решение и внедряйте его постепенно.

- Начните с малого проекта, анализируйте результаты и расширяйте автоматизацию.

Получите помощь

Если вам нужны советы по внедрению ИИ, пишите нам.

Попробуйте ИИ ассистент в продажах, который поможет отвечать на вопросы клиентов и генерировать контент для отдела продаж.

Узнайте, как ИИ может изменить ваши процессы с решениями от Flycode.ru.