«`html

Ускорение обработки больших языковых моделей с помощью Kangaroo

Развитие обработки естественного языка значительно продвинулось благодаря большим языковым моделям (LLM). Они показали выдающуюся производительность в задачах перевода, ответа на вопросы и суммирования текста, доказав их эффективность в генерации качественного текста. Однако их медленная скорость вывода остается основным ограничением для использования в реальном времени.

Проблема

Основная проблема заключается в том, что спекулятивные методы декодирования, используемые для ускорения генерации текста, требуют обучения отдельных черновых моделей. Это приводит к значительным затратам на обучение и высокой задержке вывода.

Решение

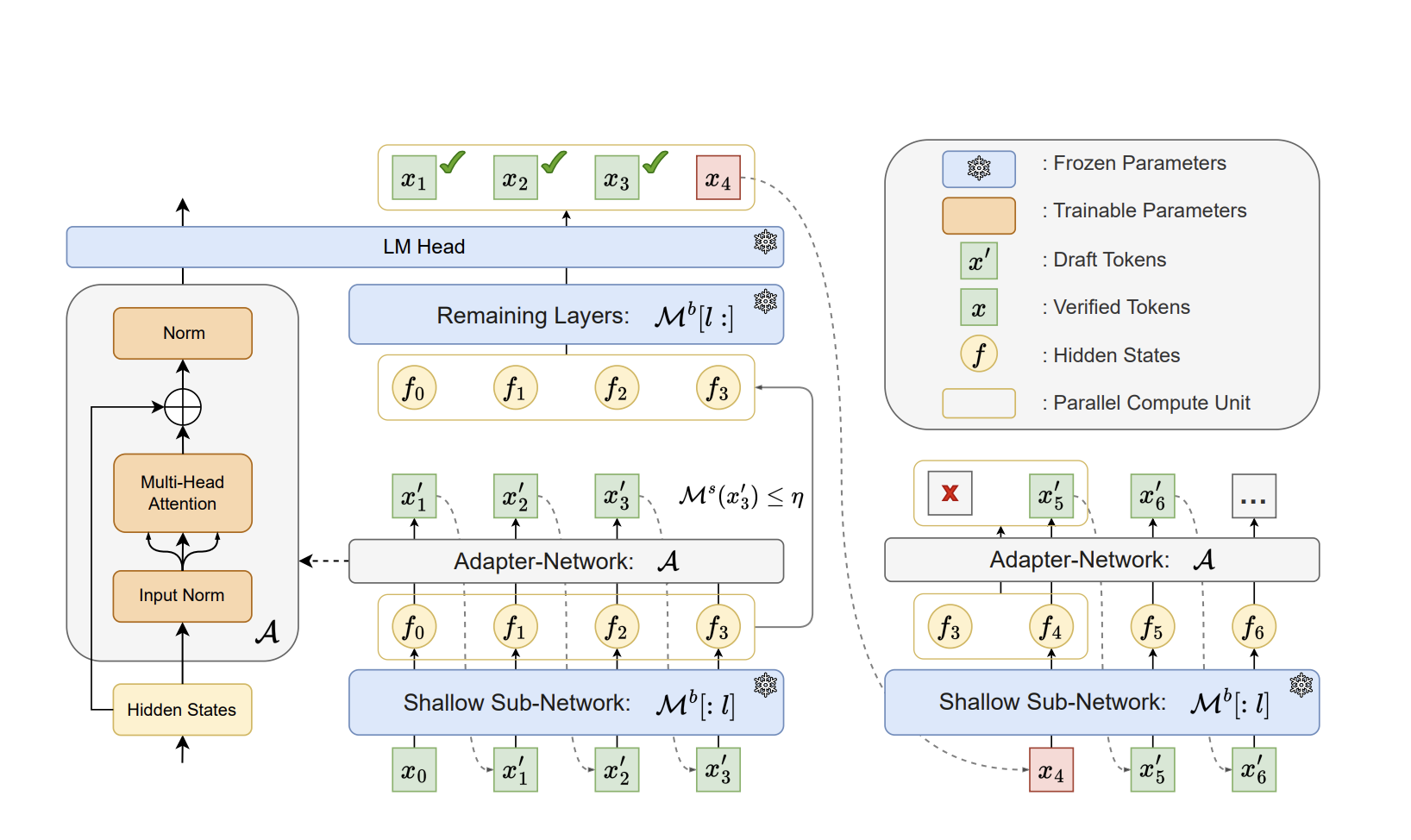

Huawei Noah’s Ark Lab разработали инновационную платформу под названием Kangaroo, которая решает проблему высокой задержки в спекулятивном декодировании. Kangaroo использует фиксированную неглубокую подсеть LLM в качестве черновой модели, что позволяет устранить необходимость в дорогостоящих внешних черновых моделях.

Эффективность

Проведенные эксперименты с помощью Spec-Bench показали, что Kangaroo достиг значительного ускорения по сравнению с другими методами, используя значительно меньше дополнительных параметров. Это инновационное решение значительно снижает задержку, делая его идеальным для приложений обработки естественного языка в реальном времени.

«`